OpenAI, el desarrollador con sede en San Francisco detrás de ChatGPT, un chatbot de inteligencia artificial (IA) generativa, depende de los servicios de computación en la nube de Microsoft Azure. Para alimentar los requisitos de computación, almacenamiento, bases de datos y redes de ChatGPT y otros productos clave de IA generativa de OpenAI, Microsoft ha realizado una inversión plurianual de 10.000 millones de dólares en OpenAI, un cambio de una participación del 49% en la empresa con una valoración total de 29.000 millones de dólares. La inversión multimillonaria de Microsoft ayudará a financiar las inmensas necesidades de infraestructura en la nube de OpenAI para entrenar y ejecutar sus diversos modelos en la plataforma en la nube Microsoft Azure.

OpenAI y ChatGPT utilizan la infraestructura en la nube de Microsoft Azure para ofrecer el rendimiento y la escala necesaria para ejecutar sus cargas de trabajo de inferencia y capacitación en inteligencia artificial (IA). La informática de alto rendimiento (HPC), el almacenamiento de datos y la disponibilidad global son fundamentales para los sistemas de ChatGPT.

Centro Infra proporciona una descripción general detallada de la infraestructura en la nube, proporcionada por Microsoft Azure, que admite OpenAI y su producto ChatGPT de modelo de lenguaje grande (LLM) basado en inteligencia artificial. Además, destacamos Azure OpenAI, el servicio de inteligencia artificial (IA) en la nube de Microsoft, así como las integraciones actuales y futuras de OpenAI de Microsoft en sus productos empresariales y de consumo.

Uso de ChatGPT y OpenAI en la nube de Microsoft Azure

Microsoft Azure es el proveedor de nube exclusivo de OpenAI y, a su vez, admite el producto de modelo de lenguaje grande (LLM) basado en inteligencia artificial de la empresa ChatGPT. A través de sus recursos de computación, almacenamiento, bases de datos y redes, Microsoft Azure impulsa todas las cargas de trabajo de OpenAI en investigación, productos y servicios de interfaz de programación de aplicaciones (API). En particular, la familia de modelos de OpenAI incluye GPT-3 para generación de lenguaje similar al humano, Codex para generación de código en muchos lenguajes de programación y Dall-E 2 para generación y edición de imágenes realistas:

Fuente: Microsoft.

- GPT-3: permite a los usuarios generar texto similar a un humano, realizar traducciones de idiomas, resumir texto y más, utilizando un modelo de procesamiento de lenguaje natural (NLP) basado en IA. ChatGPT es una versión más pequeña de GPT-3, con menos parámetros en su red neuronal

- Codex: un sistema que genera código informático para desarrolladores de software sugiriendo líneas de código y funciones completas en tiempo real. Codex, como modelo de IA subyacente, se ha convertido en un producto llamado GitHub Copilot, que puede generar fragmentos de código. En particular, GitHub es otro servicio propiedad de Microsoft utilizado principalmente por desarrolladores.

- Dall-E 2: un sistema de generación de imágenes que permite a los usuarios producir arte a partir de cadenas de texto. Dall-E 2 es utilizado por Microsoft Designer, una nueva herramienta de diseño gráfico, para crear elementos como imágenes, iconos, ilustraciones e infografías.

Se puede acceder y utilizar directamente a todos estos modelos OpenAI, y más, a través de Azure OpenAI, un servicio proporcionado por Microsoft, que se describe con mayor detalle en la siguiente sección.

En general, Microsoft Azure y su arquitectura de computación en la nube ofrecen el rendimiento y la escala requerida por las cargas de trabajo de inferencia y capacitación en inteligencia artificial (IA) de OpenAI a través de computación de alto rendimiento (HPC), almacenamiento y procesamiento de datos, disponibilidad global, elasticidad y rentabilidad:

Computación de alto rendimiento (HPC)

ChatGPT consume enormes cantidades de potencia informática, impulsada tanto por la creación como por el funcionamiento de sus sistemas de inteligencia artificial (IA). Además, el modelo de lenguaje realiza una gran cantidad de operaciones de entrada/salida (E/S), como leer o escribir datos en dispositivos de almacenamiento e intercambiar información entre dispositivos a través de una red de comunicaciones. Para evitar las importantes inversiones de capital que de otro modo serían necesarias para construir sus propios centros de datos y capacidades de red, OpenAI (desarrollador de ChatGPT) se ha asociado con Microsoft Azure.

OpenAI ha utilizado Microsoft Azure para construir e implementar múltiples “sistemas de supercomputación” de IA a escala masiva, que OpenAI emplea para entrenar todos sus modelos. Dicho de otra manera, estos son sistemas de computación de alto rendimiento (HPC) que utilizan supercomputadoras de exaescala diseñadas y optimizadas específicamente para ejecutar cargas de trabajo de inferencia y entrenamiento de IA a gran escala, como aprendizaje profundo, aprendizaje automático (ML) y procesamiento del lenguaje natural (NLP).

Normalmente, los sistemas HPC utilizan una combinación de potentes procesadores, memoria de alta velocidad y hardware especializado, como unidades de procesamiento de gráficos (GPU), para acelerar el procesamiento de grandes cantidades de datos.

Como modelo de lenguaje grande (LLM), ChatGPT se entrenó mediante aprendizaje profundo, que implica el uso de redes neuronales con muchas capas, para procesar y comprender su conjunto de datos de entrada, que para ChatGPT era más de 570 gigabytes de datos de texto. Para acelerar este proceso de entrenamiento, suelen utilizar GPU. Por ejemplo, para entrenar la última versión de GPT-3, OpenAI utilizó 175 mil millones de parámetros, 16.000 núcleos de CPU y millas de GPU NVIDIA V100.

Capacidades HPC de Microsoft Azure para ChatGPT

Microsoft Azure es el único proveedor de servicios de nube pública (CSP) global que ofrece supercomputadoras de IA con “capacidades masivas de ampliación y ampliación” – es decir, la capacidad de agregar más potencia de procesamiento y nodos al sistema, respectivamente. Con este fin, la supercomputadora Voyager-EUS2 de Microsoft Azure ocupa actualmente el puesto 14 entre las supercomputadoras TOP500 en todo el mundo y es la mejor clasificada entre los proveedores globales de servicios en la nube.

Voyager-EUS2: ubicada en la región de nube Este de EE. UU. UU. 2 de Microsoft Azure en Richmond, Virginia, esta supercomputadora tiene una potencia de procesamiento de 39.531 petaflops, lo que significa que el sistema puede procesar 10^15 (peta) operaciones de punto flotante por segundo.

Con sus supercomputadoras de IA, junto con GPU y soluciones de red, Microsoft Azure puede ofrecer de manera única el rendimiento optimizado y la escala requerida por las cargas de trabajo de inferencia y capacitación en inteligencia artificial (IA) de OpenAI. A continuación se muestran ejemplos específicos de cómo Microsoft Azure, combinado con sus supercomputadoras, diferencia la plataforma de IA de otros importantes proveedores de servicios en la nube (es decir, Amazon Web Services y Google Cloud).

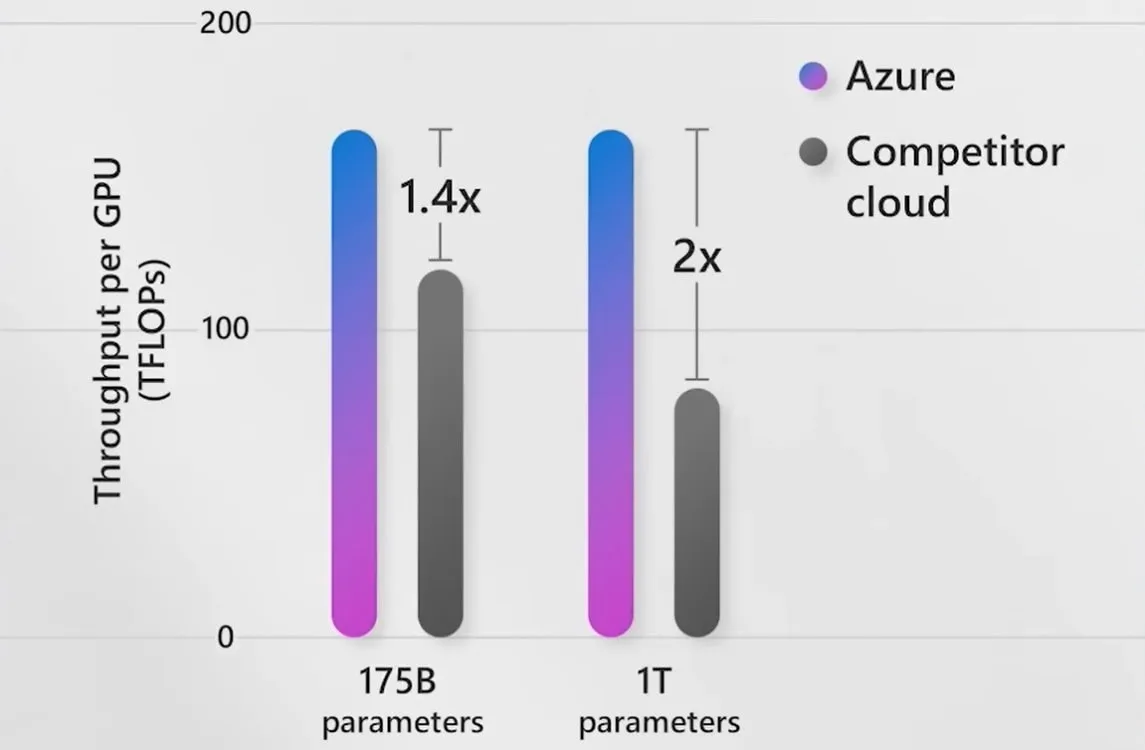

Entrenamiento de modelos de IA: rendimiento de cómputo por GPU

Microsoft Azure proporciona casi el doble de rendimiento informático por GPU, en comparación con sus competidores proveedores de servicios en la nube, y un escalado casi lineal a millas de GPU, debido a su optimización del software de sistemas y redes.

Fuente: DeepSpeed.ai.

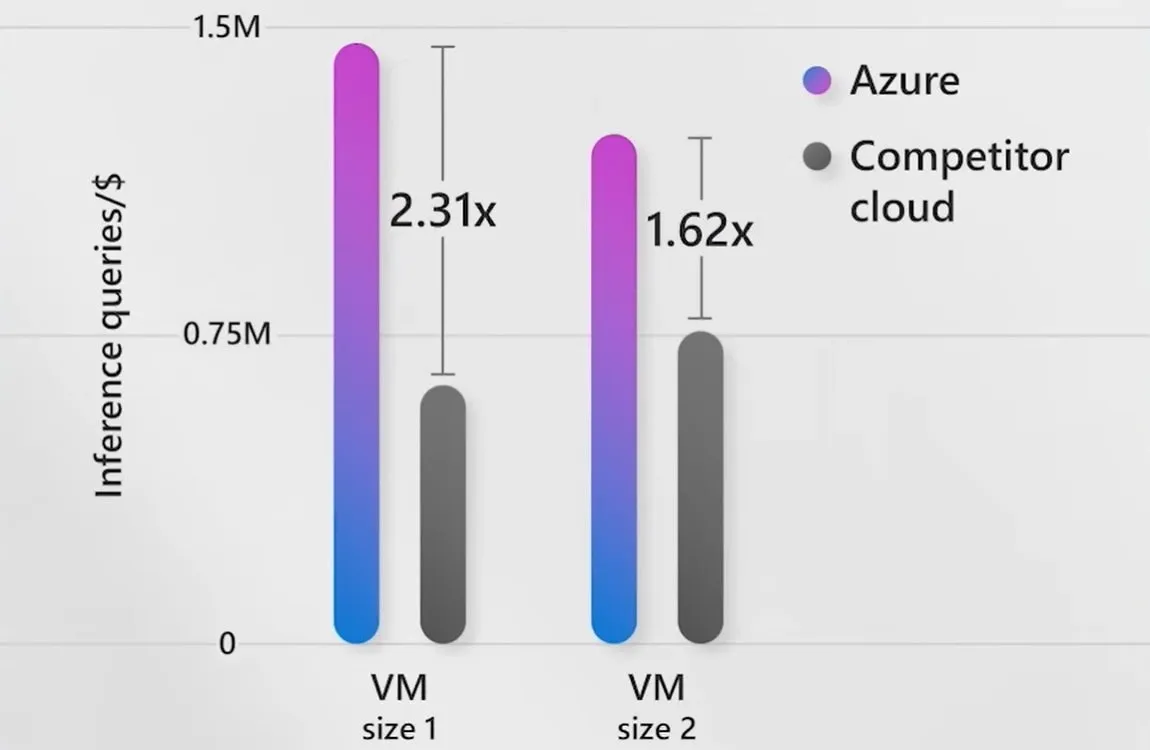

Inferencia de modelo de IA (BERT, 99 % sin conexión): consultas de inferencia por $

Para la inferencia, Microsoft Azure es más rentable que sus competidores proveedores de servicios en la nube y ofrece hasta el doble de rendimiento, en términos de consultas de inferencia por dólar.

Fuente: MLPerf Inferencia v2.

Almacenamiento y procesamiento de datos

OpenAI requiere un almacenamiento de datos escalado para almacenar y administrar el gran conjunto de datos de texto utilizado para entrenar y ejecutar el modelo ChatGPT, así como para almacenar los parámetros del modelo y otra información relacionada con el modelo. Los tipos comunes de repositorios de datos que ChatGPT puede usar son una base de datos, un almacén de datos, lago de datos, o alguna combinación de estos, dependiendo de los datos estructurados, semiestructurados y no estructurados que el sistema usa y recopila.

Dado que Microsoft Azure es el proveedor de nube exclusivo de OpenAI, ChatGPT podría utilizar los siguientes mecanismos de almacenamiento de datos:

- Azure SQL Database: un servicio de base de datos relacional, diseñado para almacenar y administrar datos estructurados, como el texto relacionado con el modelo. Alternativamente, se podría instalar y administrar en la nube un sistema de gestión de bases de datos relacionales de código abierto, como PostgreSQL.

- Azure Blob Storage: una solución de almacenamiento para grandes cantidades de datos no estructurados

- Azure Data Lake Storage: una solución de almacenamiento centralizada, escalable y rentable que almacena datos no estructurados, semiestructurados y estructurados de múltiples fuentes diversas.

OpenAI podría usar Apache Hadoop para procesamiento de datos en el entrenamiento de sus grandes modelos de lenguaje (LLM), como ChatGPT. Apache Hadoop es una implementación de Hadoop, que a su vez es un marco de código abierto para el almacenamiento distribuido y el procesamiento de grandes conjuntos de datos. Por ejemplo, Apache Hadoop permitiría a OpenAI almacenar el gran conjunto de datos de texto de ChatGPT en muchos servidores básicos en los centros de datos en la nube de Microsoft Azure, además de permitir el procesamiento paralelo de esos datos utilizando un modelo informático distribuido (es decir, donde las tareas o cargas de trabajo se dividen y ejecutan en varios servidores).

Disponibilidad global

OpenAI proporciona accede API a modelos como ChatGPT en más de 155 países, regiones y territorios, lo que hace que el producto sea accesible para los usuarios a través de una conexión a Internet. Sin embargo, ChatGPT no está disponible en más de 40 países de todo el mundo, incluidos Afganistán, Bielorrusia, Camboya, Camerún, China, Cuba, Egipto, Irán, Corea del Norte, Paraguay, Rusia, Arabia Saudita, Ucrania, Venezuela y Vietnam.

La disponibilidad global de ChatGPT se basa en parte en la disponibilidad de las más de 60 regiones de la nube de Microsoft Azure en todo el mundo, que abarcan más de 35 países. Además, la infraestructura global de Microsoft Azure utiliza centros de datos de frontera y redes de entrega de contenido (CDN) para entregar el contenido y los datos de ChatGPT a los usuarios en países donde no tiene presencia de centros de datos a gran escala.

LEER MÁS: Ubicaciones y regiones del centro de datos de Microsoft Azure

En conjunto, el centro de datos y la infraestructura de red a gran escala y distribuida globalmente de Microsoft Azure permiten baja latencia y acceso de alta velocidad al modelo ChatGPT, independientemente de la ubicación del usuario. A su vez, estas capacidades mejoran el rendimiento de las cargas de trabajo de inteligencia artificial (IA) de ChatGPT.

Además, la implementación de ChatGPT en la infraestructura de nube de Microsoft Azure garantiza que el modelo tenga alta disponibilidad y pueda manejar una gran cantidad de solicitudes simultáneamente. Más específicamente, Microsoft Azure logra esto mediante el uso de técnicas de equilibrio de carga para distribuir el tráfico entrante entre múltiples instancias del modelo.

Con este fin, Microsoft Azure puede replicar el modelo ChatGPT en múltiples centros de datos en diferentes regiones geográficas, de modo que si un centro de datos deja de funcionar, incluso se pueda acceder al modelo desde otro. En última instancia, la replicación ayuda a garantizar que el modelo esté siempre disponible, incluso en caso de que ocurra un desastre natural donde se encuentre uno de sus centros de datos.

LEER MÁS: Cómo los centros de datos están habilitando la Inteligencia Artificial (IA)

elasticidad

OpenAI y ChatGPT se benefician de la elasticidad de la nube al poder aumentar o reducir de manera fácil y automática los recursos de computación, almacenamiento, bases de datos y redes según sea necesario. Por ejemplo, cuando hay una gran demanda del modelo ChatGPT, como durante un aumento en el tráfico al sitio web de ChatGPT, Microsoft Azure puede aprovisionar automáticamente más recursos (por ejemplo, CPU y memoria) al modelo, para manejar el aumento de carga. Por el contrario, cuando la demanda disminuye, se pueden desaprovisionar recursos para ahorrar costos. A su vez, la elasticidad permite el uso eficiente de los recursos y puede ayudar a mantener el control de los gastos.

Rentabilidad

Al utilizar OpenAI y ChatGPT los servicios de computación en la nube de Microsoft Azure – en lugar de construir sus propios centros de datos – la empresa y su modelo pueden “alquilar” la infraestructura, beneficiándose de ahorros en gastos operativos, a través de un modelo de precios de pago por uso, y gastos de capital, a través de una inversión inicial limitada.

Precios de pago por uso

Al utilizar Microsoft Azure, OpenAI puede pagar solo cuando ChatGPT consume recursos de computación, almacenamiento, bases de datos y redes, y pagar solo por la cantidad que consume ChatGPT. Este modelo de precios puede ayudar a mantener el control sobre los gastos operativos, especialmente porque la demanda del modelo ChatGPT fluctúa diariamente e incluso cada hora.

inversion inicial

En lugar de invertir de capital en la construcción y mantenimiento de centros de datos, servidores y unidades de procesamiento de gráficos (GPU), OpenAI y ChatGPT pueden confiar en la infraestructura de nube existente de Microsoft Azure. Como tal, Microsoft Azure puede aprovisionar las máquinas virtuales (VM) y GPU para entrenar y ejecutar los grandes modelos de lenguaje (LLM) de OpenAI y ChatGPT. Por ejemplo, Microsoft Azure ofrece máquinas virtuales de las series NV y NC, que están equipadas con GPU NVIDIA y están optimizadas para cargas de trabajo con uso intensivo de computación y GPU.

LEER MÁS: Computación acelerada: ¿Qué es? y ¿Cómo funciona?

Azure OpenAI: servicio de IA en la nube de Microsoft

Azure OpenAI es un servicio proporcionado por Microsoft que permite a las empresas y desarrolladores acceder directamente y utilizar modelos IA generativa a gran escala previamente formados de OpenAI, como GPT-3.5, para crear sus propias aplicaciones de inteligencia artificial (IA). Es importante destacar que Azure OpenAI permite a los desarrolladores integrar las capacidades de los modelos OpenAI en sus propios proyectos y crear nuevas aplicaciones basadas en sus capacidades, a menudo aprovechando las soluciones de IA existentes de Microsoft Azure, como Azure Cognitive Services y Azure Machine Learning. Además, Azure OpenAI proporciona un medio para que los desarrolladores escale e implemente globalmente modelos OpenAI de forma segura y confiable.

En enero de 2023, Microsoft anunció la disponibilidad general del servicio Azure OpenAI, lo que permitirá que más empresas soliciten acceso a los servicios API de OpenAI, incluido GPT-3.5. (una versión mejorada del modelo GPT-3 de OpenAI), DALL-E 2 y Codex. A través del servicio Azure OpenAI, las empresas pronto también podrán acceder a ChatGPT, una versión mejorada de GPT-3.5 que ha sido entrenada y ejecuta inferencia en la infraestructura de Azure AI.

Cómo utilizar Azure OpenAI

Azure OpenAI está disponible con carácter general, pero el servicio actualmente requiere una suscripción a Azure y un registro a través de la aplicación. Una vez que se otorga acceso al servicio Azure OpenAI, los clientes pueden usar los modelos de OpenAI a través de API REST (un conjunto de reglas para acceder al software basado en web), Python SDK o creando un recurso que los vinculará a Azure OpenAI Studio, una interfaz basada en web. Con Azure OpenAI Studio, los clientes pueden configurar una implementación para realizar llamadas API contra un modelo base proporcionado (por ejemplo, text-davinci-002) o un modelo personalizado.

Azure OpenAI Studio permite a los desarrolladores experimentar con indicaciones y probar sus ideas con OpenAI antes de incorporarlas a su código. Una vez que los desarrolladores hayan terminado de experimentar, pueden llamar a un servicio particular desde su código e integrarlo en sus aplicaciones.

Integración OpenAI de Microsoft en consumidores y empresas

Microsoft ya ha integrado los modelos de OpenAI en varios de sus productos empresariales y de consumo “propios”, a saber, Microsoft 365, Dynamics 365, Power Platform, GitHub Copilot y Microsoft Designer. En última instancia, el objetivo de la empresa con estas integraciones es mejorar la experiencia del usuario y permitir tareas automatizadas más eficientes y precisas.

- Microsoft 365: Los modelos de OpenAI están integrados en las herramientas de productividad y colaboración de Microsoft, como Office y Microsoft Teams. En Office, los modelos de OpenAI se pueden utilizar para ayudar con las tareas de escritura y formato. Mientras están en Microsoft Teams, los modelos pueden ayudar con la programación y la transcripción de reuniones.

- Dynamics 365: Los modelos de OpenAI están integrados en el software de planificación de recursos empresariales (ERP) y gestión de relaciones con el cliente (CRM) de Microsoft para mejorar la experiencia de servicio al cliente. Por ejemplo, al utilizar la tecnología de comprensión del lenguaje natural de OpenAI, Dynamics 365 puede comprender y responder a las consultas de los clientes de manera más eficiente.

- Power Platform: Los modelos de OpenAI están integrados en la herramienta de automatización empresarial de Microsoft para permitir capacidades de procesamiento del lenguaje natural, como la generación, comprensión y diálogo del lenguaje natural. Por ejemplo, Power BI, que es la herramienta de visualización de datos e inteligencia empresarial de Microsoft, aprovecha el lenguaje natural impulsado por GPT-3 para generar automáticamente fórmulas para realizar cálculos.

- GitHub Copilot: Los modelos de OpenAI están integrados en el producto de Microsoft para generar fragmentos de código.

- Microsoft Designer: Los modelos de OpenAI están integrados en la herramienta de diseño gráfico de Microsoft, para crear elementos como imágenes, iconos, ilustraciones e infografías.

Futuras integraciones de OpenAI en los productos empresariales y de consumo de Microsoft

El director ejecutivo de Microsoft, Satya Nadella, ha declarado que su empresa planea incorporar herramientas de inteligencia artificial (IA) en todos sus productos “propios” y “en cada capa de la pila” para que otras empresas puedan aprovecharlas. Ejemplos de productos de Microsoft que podrían, en el futuro, integrarse con los modelos de OpenAI incluyen Bing, LinkedIn, OneDrive y Xbox:

- Bing: Los modelos de OpenAI se pueden utilizar para mejorar el procesamiento del lenguaje natural (NLP) del motor de búsqueda para comprender mejor la intención de búsqueda, generar fragmentos de búsqueda más informativos para la página de resultados de Bing y producir predicciones de autocompletar más relevantes para las consultas de búsqueda de Bing.

- LinkedIn: Los modelos de OpenAI se pueden utilizar en la plataforma de red profesional para resumir automáticamente los currículums de los candidatos a puestos de trabajo para los reclutadores, generar texto para descripciones de puestos y publicaciones de empresas, y mejorar las capacidades de coincidencia de LinkedIn, sugiriendo oportunidades laborales más relevantes a los solicitantes de empleo y candidatos más adecuados a los reclutadores.

- OneDrive: Los modelos de OpenAI se pueden utilizar para mejorar el etiquetado y la categorización automática de archivos del servicio de alojamiento de archivos, las capacidades de búsqueda en lenguaje natural, en lugar de tener que recordar el nombre o la ubicación exacta del archivo, y el resumen automático del contenido de los documentos.

- Xbox: Los modelos de OpenAI se pueden usar para mejorar el motor de recomendación del servicio de videojuegos para juegos en Xbox Game Pass y Xbox Cloud Gaming, el diálogo dentro del juego y las interacciones de los personajes, y las capacidades de reconocimiento de voz para permitir el uso de comandos de voz para controlar un juego.

“La próxima gran ola de plataformas, como dije, será la IA y será fuerte. También creemos que gran parte del valor empresarial se crea simplemente siendo capaz de atrapar estas olas y luego hacer que esas olas impacten cada parte de nuestra pila tecnológica y también creen nuevas soluciones y nuevas oportunidades”. Satya Nadella – Microsoft Corporation – Presidente y director ejecutivo – 24/01/2023