Un centro de datos está equipado con hardware de red avanzado, lo que garantiza que todos los servidores mantengan conexiones seguras y eficientes tanto a Internet pública como a redes privadas. Esta infraestructura de red es crucial, ya que satisface las diversas necesidades de conectividad que plantean diversas aplicaciones, cada una de las cuales es integral para lograr los objetivos de una organización. Por lo tanto, es esencial comprender los requisitos únicos de una red de centro de datos moderna, así como comprender la topología de red especialmente diseñada que forma su columna vertebral.

Las redes de centros de datos integran varios activos de red, incluidos conmutadores, enrutadores y equilibradores de carga, para manejar el almacenamiento de datos y el procesamiento de aplicaciones. Establece conexiones entre los componentes y dispositivos del centro de datos, lo que facilita la transferencia de datos sin problemas a través de Internet o redes privadas.

Centro Infra proporciona un análisis en profundidad de las redes de centros de datos, destacando su importancia en los centros de datos modernos. Ofrecemos información detallada sobre varias arquitecturas de red (específicamente, las topologías de tres niveles y de hoja espinal) junto con una descripción general del hardware, el software y los protocolos críticos en uso. Además, Centro Infra explora las estrategias operativas que mejoran la eficiencia y la adaptabilidad en entornos de redes de centros de datos. Continúe leyendo para obtener una comprensión integral de estos sistemas complejos.

¿Qué son las redes de centros de datos?

La red de centros de datos es un sistema que integra varios recursos de red, como conmutadores, cables, enrutadores, equilibradores de carga, firewalls, sistemas de almacenamiento, redes privadas virtuales (VPN) y sistemas de prevención de intrusiones (IPS). Estos componentes de hardware y software trabajan juntos para optimizar la conectividad, el almacenamiento, el procesamiento, la administración y la seguridad de diversas aplicaciones y datos. Sin estos componentes integrales, los dispositivos dentro de un centro de datos no podrían comunicarse entre sí ni conectarse a redes externas.

En un ámbito más amplio, las redes del centro de datos comprenden varias redes distintas: la red de área local (LAN) interna de la sala de computadoras, la red de área de almacenamiento (SAN) y las conexiones de red de área amplia (WAN) externas. Nuestra discusión se centra principalmente en los aspectos internos de las redes del centro de datos.

Evolución de las redes de centros de datos: de lo tradicional a lo moderno

La evolución de las redes de centros de datos ha estado marcada por un cambio de arquitecturas tradicionales dependientes del hardware con escalabilidad limitada a enfoques modernos que enfatizan la virtualización, la flexibilidad y tecnologías como redes definidas por software (SDN) para mejorar la eficiencia y la escalabilidad.

Desafíos de las redes de centros de datos tradicionales.

Las redes de centros de datos tradicionales dependen en gran medida del hardware y de los servidores locales, una dependencia que puede generar problemas de confiabilidad, limitaciones de almacenamiento y problemas de latencia, particularmente en la medida que los volúmenes de datos continúan creciendo rápidamente. Escalar estas redes tradicionales implica implementar conmutadores y enrutadores más grandes, un enfoque que no sólo es costoso sino que también está limitado por la capacidad física del centro de datos. Además, estos dispositivos más grandes y complejos son más susceptibles a fallas, y sus fallas pueden tener mayores consecuencias en las redes de los centros de datos.

Advenimiento de las redes de centros de datos modernos.

Por el contrario, las soluciones de redes de centros de datos modernos utilizan virtualización, que admiten aplicaciones y cargas de trabajo que se ejecutan en servidores físicos, así como entornos de nube pública, nube privada, nube híbrida y nube múltiple. Estos sistemas modernos sustentan una amplia gama de servicios de datos y garantizan conexiones ininterrumpidas entre máquinas virtuales (VM) distribuidas, contenedores, arquitectura de microservicios y aplicaciones bare metal. También ofrecen una administración de red simplificada a través de plataformas de gestión centralizada y mejoran la seguridad del centro de datos a través de mecanismos de control granular.

Si bien las redes modernas de centros de datos continúan utilizando componentes de infraestructura física como enrutadores, conmutadores, firewalls y servidores, aprovechan cada vez más elementos de software (incluidos sistemas de gestión y automatización) para garantizar la distribución confiable y eficiente de datos y servicios a los usuarios finales.

Importancia de las redes del centro de datos

La importancia de las redes de centros de datos es multifacética, dada su función de conectar, proteger y adaptar dinámicamente los entornos organizacionales. Las redes de centros de datos brindan servicios esenciales para aplicaciones y datos, incluida alta disponibilidad y confiabilidad, escalabilidad y flexibilidad, seguridad de datos mejorada, utilización eficiente de recursos, optimización del tráfico de red y servicios de virtualización y nube.

1. Alta disponibilidad y confiabilidad

Las redes de centros de datos aseguran alta disponibilidad y confiabilidad a través de estrategias como clustering, balanceo de carga e interconexión de sistemas para redundancia.

- Clúster: Se refiere a la conexión de Múltiples servidores o dispositivos, conocidos como nodos, para operar como una única unidad lógica para lograr redundancia y alta disponibilidad. Esta configuración está diseñada para evitar cualquier punto único de falla. Si un nodo encuentra un problema, su carga de trabajo se redistribuye automáticamente entre los demás nodos del clúster, lo que garantiza un servicio ininterrumpido.

- Equilibrio de carga: Implica distribuir el tráfico de red y las cargas de trabajo entre Múltiples servidores, enlaces de red, unidades de disco y sistemas para evitar que un solo recurso se vea abrumado. A través de hardware y software, los balanceadores de carga garantizan que ningún servidor tenga demasiada demanda, mejorando así los tiempos de respuesta generales y la tolerancia a fallos.

- Redundancia: Se logra mediante el uso de equipos adicionales, conmutadores incluidos, enrutadores, puertas de enlace y firewalls, así como opciones de conectividad alternativas para la conmutación por error. Esta estrategia proporciona alta disponibilidad, incluso en caso de falla del dispositivo principal. Los protocolos específicos conocidos como protocolos de redundancia de primer salto (FHRP) respaldan esta alta disponibilidad y redundancia. Los FHRP funcionan agrupando varios enrutadores en una única entidad virtual que comparte una dirección común. Esta configuración no solo mejora la resiliencia del sistema sino que también garantiza el equilibrio de carga para una alta disponibilidad sostenida.

2. Escalabilidad y flexibilidad

Las redes de centros de datos brindan flexibilidad a las empresas, permitiéndoles ampliar o reducir las operaciones en respuesta a las fluctuaciones en el volumen de datos, la demanda de los usuarios y los requisitos de las aplicaciones. La arquitectura que logra esta versatilidad combina dos componentes integrales: una red subyacente basada en IP que conecta dispositivos físicos y una red virtual superpuesta que integra un plano de control y un plano de datos. Esta estructura permite una conectividad eficiente entre varios puntos finales, incluidos servidores, conmutadores e infraestructura de almacenamiento.

Los centros de datos tradicionales frecuentemente encuentran que los métodos de ampliación, como agregar puertos de switch o aumentar su velocidad, son prohibitivamente costosos. Esto ha llevado a una preferencia por estrategias de ampliación, que implican agregar más sistemas para mejorar la flexibilidad y la rentabilidad. Los centros de datos modernos, que pueden albergar de millas a millones de servidores en una sola instalación, requieren redes altamente escalables. Para estas instalaciones, la escalabilidad se logra a través de un enfoque de ampliación, evitando el reemplazo significativo de dispositivos y el recableado que necesitarían los métodos de ampliación.

3. Seguridad de datos mejorada

Las redes de centros de datos facilitan la gestión centralizada y granular de la seguridad al establecer políticas uniformes y emplear protocolos, procedimientos y herramientas estandarizadas. Esto garantiza la integridad, confidencialidad y acceso controlado a los datos.

Las medidas de seguridad integradas en las redes de los centros de datos incluyen firewalls, cifrado de datos, listas de control de acceso (ACL), sistemas de detección de intrusiones (IDS), sistemas de prevención de intrusiones (IPS), redes privadas virtuales (VPN) y microsegmentación. Juntos, estos componentes controlan el tráfico de la red, protegen los datos confidenciales y evitan el acceso no autorizado a varios sistemas y aplicaciones.

4. Utilización eficiente de los recursos

Las redes de centros de datos bien diseñados permiten a las empresas distribuir datos y recursos en Múltiples entornos informáticos, incluidas plataformas en la nube, centros de datos locales y ubicaciones de frontera. Este diseño permite la utilización y asignación eficiente del almacenamiento, la potencia de procesamiento y el ancho de banda, lo que conduce a una mayor eficiencia operativa y escalabilidad del sistema, lo que a su vez genera una reducción de los costos operativos.

Además, la consolidación de la información en un sistema de gestión centralizado, conocido como “Panel único”, optimiza la gestión de datos al proporcionar una vista integrada y completa de todos los sistemas de almacenamiento.

5. Optimización del tráfico de red

Las redes de centros de datos utilizan protocolos de enrutamiento preferidos, incluido el protocolo de puerta de enlace fronteriza (BGP) y el enrutamiento de rutas Múltiples de igual costo (ECMP), junto con tecnologías de automatización como redes definidas por software (SDN) y redes basadas en intenciones (IBN). Estas tecnologías determinan colectivamente las rutas más eficientes para el cruce de paquetes de datos, mejorando significativamente las velocidades de transmisión de datos y la eficiencia general. Al abordar los problemas comunes de congestión de la red que se encuentran en los centros de datos tradicionales, reduce la latencia, lo cual es fundamental para mejorar el rendimiento y la confiabilidad del centro de datos.

6. Virtualización y servicios en la nube

Las soluciones modernas de redes de centros de datos son fundamentales tanto para la tecnología de virtualización como para los servicios basados en la nube, ya que ejecutan todos los servicios de red esenciales que requieren las aplicaciones comerciales tradicionales en forma de software. Este enfoque reemplaza las tareas de aprovisionamiento que antes eran manuales y propensas a errores con automatización, simplificando así la implementación, el escalado y la distribución de recursos entre máquinas virtuales (VM). Como resultado, las redes de centros de datos virtualizados no sólo mejoran la flexibilidad y reducen la carga de trabajo administrativo, sino que también ofrecen soluciones rentables y escalables que superan las capacidades de la infraestructura física tradicional.

Arquitectura y topología de redes de centros de datos.

La arquitectura y topología de las redes de los centros de datos son fundamentales para diseñar, organizar, optimizar y escalar la estructura interna y el diseño de un centro de datos. Este proceso se centra en la configuración e interconexión de servidores, infraestructura de almacenamiento, dispositivos de red y rutas dentro del centro de datos. Una arquitectura y una topología bien planificada garantizan una comunicación de datos eficiente y confiable entre servidores y clientes.

Durante décadas, la arquitectura de tres niveles ha sido el modelo estándar para las redes de centros de datos. Sin embargo, es crucial reconocer el surgimiento de topologías alternativas, especialmente la arquitectura de hoja espinal, que es cada vez más prominente en los entornos de centros de datos modernos. Esta arquitectura prevalece en entornos de computación de alto rendimiento (HPC) y es la opción predominante entre los proveedores de servicios en la nube (CSP). Las siguientes secciones ofrecerán una comparación en profundidad de estas dos arquitecturas de red de centros de datos únicos.

No obstante, antes de explorar los detalles de cada arquitectura, es fundamental comprender los diversos patrones de tráfico a los que se enfrentan los centros de datos, ya que estos patrones han tenido y seguirán teniendo un impacto significativo en las decisiones de topología y diseño de red.

Patrones de tráfico en los centros de datos.

Los centros de datos transmiten cantidades significativas de datos mediante el uso de conmutadores, cables y enrutadores tanto dentro de una instalación como entre instalaciones. Este proceso se distingue por dos categorías principales de patrones de tráfico: norte-sur y este-oeste.

Haga clic aquí para ver una versión más grande de esta imagen.

- Norte-Sur: Este tráfico se refiere a datos que ingresan (hacia el sur) o salen (hacia el norte) de un centro de datos, es decir, la comunicación entre los servidores y el mundo externo, incluido Internet. El tráfico norte-sur involucra dispositivos de red como enrutadores de frontera, firewalls y equilibradores de carga.

- Este-Oeste: Este tráfico se refiere al movimiento de datos entre sistemas dentro de un centro de datos, incluidas actividades como tráfico de servidor a servidor, equilibrio de carga, copias de seguridad y registros, sin distinción entre direcciones “este” u “oeste”. El tráfico este-oeste involucra dispositivos de red como enrutadores internos, firewalls y conmutadores.

La prevalencia de cualquiera de los tipos de tráfico en las redes de centros de datos está determinada por la aplicación específica en uso, particularmente si su funcionalidad está orientada externamente o concentrada en cálculos internos. Sin embargo, en general, el tráfico de este a oeste es predominante y constituye aproximadamente 70% a 80% de todo el tráfico del centro de datos. Esta estadística subraya la naturaleza crítica de la comunicación interna de servidor a servidor, que está impulsada en gran medida por las demandas de ancho de banda de intercambios de datos extensos, como los requeridos por los servicios de big data y las plataformas de computación en la nube.

Arquitectura de red de centro de datos de tres niveles

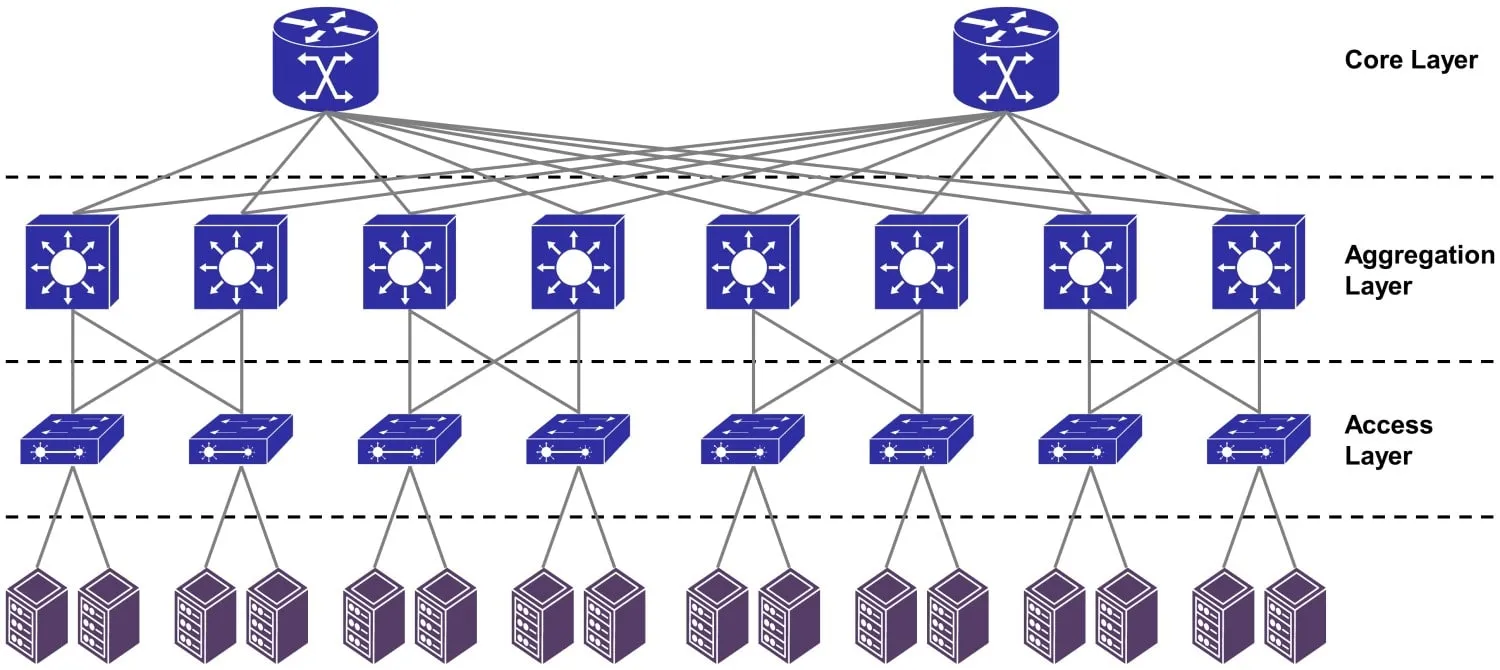

La arquitectura de red del centro de datos de tres niveles es una topología de red tradicional que ha sido ampliamente adoptada en muchos centros de datos más antiguos y a menudo se la denomina modelo de “acceso de agregación de núcleos” o modelo de “acceso de distribución de núcleos”. La redundancia es una parte clave de este diseño, con múltiples rutas desde la capa de acceso al núcleo, además de ayudar a las redes a lograr una alta disponibilidad y una asignación eficiente de recursos.

A continuación se ofrece una descripción general de cada nivel en la arquitectura de red del centro de datos de tres niveles:

Haga clic aquí para ver una versión más grande de esta imagen.

1. Capa de acceso

La capa de acceso, también conocida como capa de borde, es el nivel más bajo en la arquitectura de red del centro de datos de tres niveles. Sirve como punto de entrada para servidores, sistemas de almacenamiento y otros dispositivos (nodos finales) a la red. En la capa de acceso, los conmutadores y cables (como 10 Gigabit Ethernet (GbE), 25 GbE o 100 GbE) proporcionan conectividad para estos servidores y sistemas de almacenamiento y controlan qué dispositivos pueden comunicarse a través de la red.

Una configuración común es la configuración de conmutación top-of-rack (ToR). A esta disposición, cada rack de equipos tiene al menos un interruptor de Capa 2 colocado en la parte superior del rack. Estos conmutadores establecen conexiones a todos los sistemas dentro de sus respectivos bastidores. En particular, los conmutadores de la parte superior del rack comparten el mismo espacio de rack que los servidores a los que dan servicio, en lugar de estar alojados en racks separados.

Los conmutadores en la capa de acceso pueden aplicar varias políticas, como configuraciones de seguridad y asignaciones de red de área local virtual (VLAN). La redundancia en esta capa a menudo se logra mediante el uso de interfaces de red duales en los servidores, conectándose a diferentes conmutadores para garantizar la conectividad de la red si falla una ruta.

2. Capa de agregación

La capa de agregación, también conocida como capa de distribución, forma el puente entre la capa de acceso y la capa central. Desempeña un papel crucial en la consolidación del tráfico de datos desde los conmutadores de la parte superior del rack en la capa de acceso antes de transmitirlo a la capa central, donde se enruta a su destino final.

Considere la función de un conmutador de agregación ubicado al final de una fila de servidores, que consolida y administra el tráfico de red desde las placas de servidores dentro de su fila. En esta capacidad, actúa como un conmutador de fin de fila (EoR), reenviando estos datos compilados a la capa central. Esta función de capa de agregación es especialmente crítica en grandes centros de datos, donde una única instalación de centro de datos a menudo alberga millas de racks.

Los conmutadores de agregación suelen ser dispositivos multicapa, lo que facilita el reenvío desde la Capa 2 (lado de acceso) a la Capa 3 (lado central). Para lograr la confiabilidad de la red, es una práctica común implementar dos conmutadores de agregación para cada conmutador de acceso. Esta redundancia protege contra posibles fallas de los propios conmutadores de agregación o de los cables de conexión entre los conmutadores de agregación y de acceso. Como resultado, la capa de agregación mejora la resiliencia y la alta disponibilidad de la red del centro de datos al ofrecer múltiples rutas independientes, eliminando así puntos únicos de falla.

Además, la capa de agregación sirve como un punto crítico para controlar y dar forma al tráfico de red, implementar políticas y ejecutar funciones como equilibrio de carga, calidad de servicio (QoS), filtrado de paquetes y colas. Además, esta capa maneja el enrutamiento entre VLAN, dirigiendo de manera eficiente el tráfico entre diferentes VLAN establecidas en la capa de acceso.

3. Capa central

La capa central, también conocida como columna vertebral, es la parte central de alta capacidad de la red, diseñada específicamente para ser altamente redundante y resistente. Como corazón de la red, esta capa interconecta todos los conmutadores ubicados en la capa de agregación, facilitando el enrutamiento eficiente del tráfico entre ellos. Además, sirve como punto de conexión a redes externas, incluido Internet.

Operando en Nivel 3, la capa central es responsable de transportar grandes volúmenes de tráfico de manera rápida y confiable. Priorice la velocidad, la latencia mínima y la conectividad, en lugar de la manipulación o el filtrado de datos.

Para admitir una transmisión de datos rápida e ininterrumpida en toda la red, la capa central suele utilizar conmutadores de alta gama y cables de alta velocidad (como 40 GbE, 100 GbE y 400 GbE) con enlaces redundantes. Además, esta capacidad implementa protocolos de enrutamiento con tiempos de convergencia más bajos para mantener la eficiencia operativa. Estas garantizan que los paquetes de datos lleguen a sus destinos con un retraso mínimo.

En cuanto a la redundancia, es una práctica estándar implementar dos conmutadores centrales para cada conmutador de acceso, proporcionando así múltiples rutas de enrutamiento.

Desventajas de la arquitectura de tres niveles.

Los centros de datos tradicionales, inicialmente diseñados para manejar grandes volúmenes de tráfico que ingresan y salen de las instalaciones (tráfico norte-sur), han tenido dificultades para adaptarse a las cargas de trabajo modernas que generan un tráfico significativo de servidor a servidor. Esta limitación se debió principalmente a su dependencia de la arquitectura de red de tres niveles, que no se desarrolló teniendo en mente el tráfico de servidor a servidor (este-oeste).

La llegada de la virtualización de servidores, incluida la adopción generalizada de máquinas virtuales (VM), contenedores y arquitectura de microservicios, ha aumentado sustancialmente la cantidad de tráfico de este a oeste. Este cambio reveló una deficiencia crítica del diseño tradicional de tres niveles: no estaba optimizado para el intenso tráfico de este a oeste que implican estas tecnologías.

Un problema importante con el modelo tradicional de tres niveles fue la latencia introducida por los Múltiples “saltos” entre capas, desde la capa central a la capa de agregación y finalmente a la capa de acceso. Esta latencia degrada el rendimiento, especialmente para las aplicaciones que dependen de una comunicación rápida de servidor a servidor.

En respuesta a las ineficiencias de la arquitectura tradicional de tres niveles para manejar el tráfico de este a oeste, los centros de datos han adoptado cada vez más la arquitectura de hoja espinal, particularmente para aplicaciones de redes en la nube. Este nuevo enfoque reduce la latencia y mejora el rendimiento al facilitar una comunicación más directa y flexible de servidor a servidor.

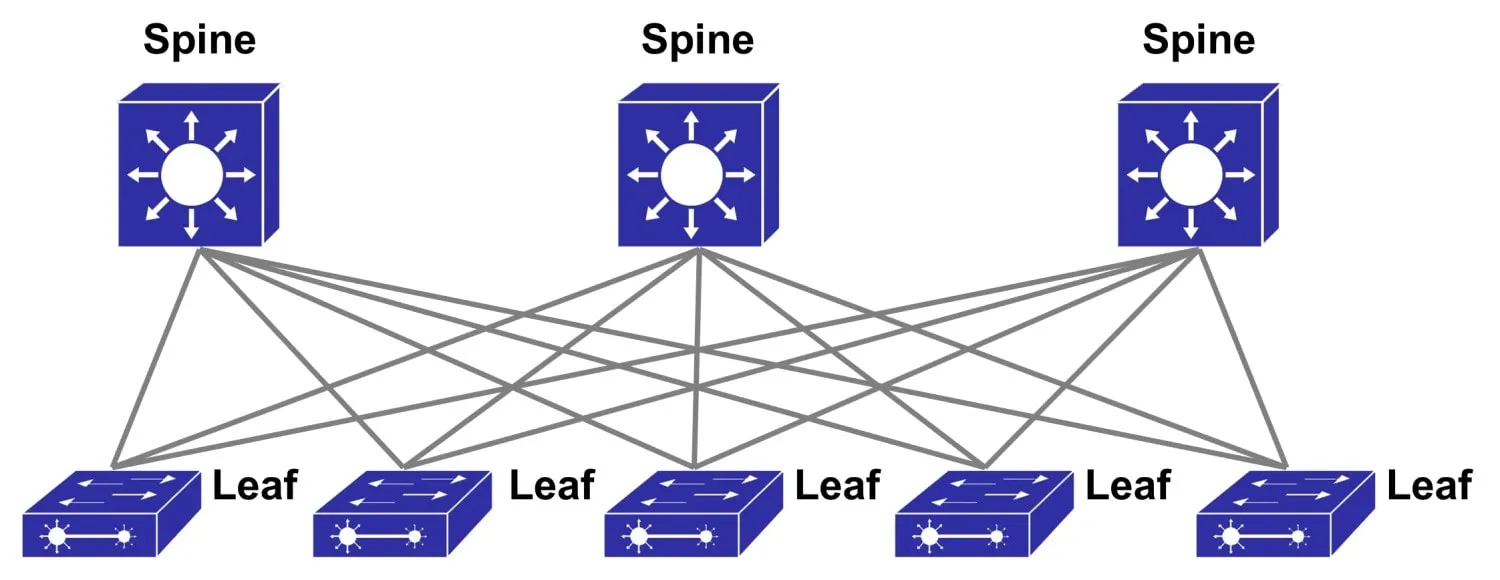

Arquitectura de columna-hoja

La arquitectura de hoja espinal, a menudo denominada diseño Clos, es una topología de red de dos niveles que se usa ampliamente en centros de datos y entornos de TI empresarial. Aporta múltiples beneficios para la infraestructura del centro de datos, como escalabilidad, latencia reducida y rendimiento mejorado en comparación con las arquitecturas de red tradicionales de tres niveles.

Haga clic aquí para ver una versión más grande de esta imagen.

Los componentes de la arquitectura lomo-hoja son los siguientes:

- Switches hoja: Son conmutadores top-of-rack situados en la capa de acceso. Los puertos de los conmutadores hoja se conectan a varios servidores, incluidos servidores físicos e instancias virtualizadas, así como dispositivos de almacenamiento dentro del bastidor. Cada interruptor de hoja está conectado a cada interruptor de columna, formando una red de malla completa. Esto garantiza que todas las rutas de reenvío estén disponibles y que todos los nudos estén a la misma distancia en términos de saltos.

- Swiches Spine: Actúan como la columna vertebral de la red del centro de datos, desempeñando las funciones de las capas centrales y de agregación de los diseños tradicionales. Los conmutadores espinales son responsables de interconectar todos los conmutadores de hoja y encaminar el tráfico entre ellos. Sin embargo, no se conectan entre sí directamente, ya que la arquitectura de red en malla elimina la necesidad de conexiones dedicadas entre los conmutadores principales. En lugar de conexiones directas de servidor a servidor (este-oeste), el tráfico se dirige a través de la capa central, lo que permite transferencias de datos sin bloqueo entre servidores en diferentes conmutadores de hoja.

Las arquitecturas de red de centros de datos modernos favorecen cada vez más la conexión de servidores a conmutadores hoja utilizando enlaces de 25G o más, mientras que las interconexiones de conmutadores funcionan a 100G o más.

Los proveedores de servicios en la nube (CSP), como Google, y las grandes empresas de Internet como Meta Platforms (anteriormente Facebook), adoptan la arquitectura de hoja espinal dentro de la infraestructura de su centro de datos. También aplican personalizaciones específicas para satisfacer sus requisitos únicos, utilizando arquitecturas de columna vertebral más complejas para escalar aún más rápido.

Ventajas de la arquitectura de hoja lomo

La arquitectura de hoja espinal ofrece varias ventajas significativas sobre la arquitectura tradicional de tres niveles, lo que la convierte en una alternativa superior para las redes de centros de datos modernos.

- Escalabilidad: Se expande fácilmente agregando conmutadores principales (que aumentan el ancho de banda transversal) o conmutadores de hoja (que se adaptan a más hosts), lo que permite el crecimiento de la red con una reconfiguración mínima de las conexiones existentes. Además, VXLAN (LAN extensible virtual) mejora la escalabilidad al facilitar la expansión de las redes de Capa 2 (capa de enlace de datos) sobre la infraestructura de Capa 3 (capa de red) existente, todo sin la necesidad de expansión de hardware físico.

- Latencia reducida: Menos niveles de red y recuentos de saltos conducen a una latencia más baja, lo cual es beneficio para aplicaciones de alto rendimiento que requieren una comunicación rápida y constante entre servidores.

- Rendimiento predecible: El enrutamiento multiruta de igual costo (ECMP) permite un flujo de tráfico consistente y con carga equilibrada, optimizando el uso de recursos de la red del centro de datos.

- Eficiencia del tráfico Este-Oeste: Inherentemente optimizado para el movimiento lateral de datos dentro de la infraestructura del centro de datos, satisfaciendo las demandas de aplicaciones y tecnologías modernas como la virtualización y la computación en la nube, incluidas la nube pública y la nube privada.

- Tolerancia a fallos: La alta interconectividad garantiza la redundancia de la ruta de datos, lo que mejora la resiliencia de la red ante fallos o interrupciones. En caso de falla de un enlace o conmutador (o incluso fallas múltiples), la red del centro de datos puede adaptarse y redireccionar rápidamente el tráfico, evitando la pérdida total de conectividad y minimizando el tiempo de inactividad.

- Sin preocupaciones sobre bucles: Evita internamente los bucles de red debido a su topología sin bloqueo, lo que elimina la necesidad del protocolo de árbol de expansión (STP) y optimiza la utilización de rutas, lo que simplifica la administración de la red del centro de datos y mejora el rendimiento.

Sin embargo, es importante reconocer que la arquitectura columna vertebral requiere una inversión sustancial en cableado, incluidos Ethernet y fibra óptica, debido a su diseño de conectividad de malla completa. A pesar de esto, sus beneficios a menudo justifican el compromiso inicial de recursos.

Hardware, software y protocolos de red para centros de datos

El hardware, el software y los protocolos de red son los componentes esenciales necesarios para diseñar, construir, implementar y administrar una red de centro de datos. Estos elementos garantizan que la red funcione de manera eficiente, confiable y segura.

interruptores

Los conmutadores de centros de datos son dispositivos que filtran y reenvían paquetes entre diferentes dispositivos en la misma red, lo que ayuda a administrar y encaminar de manera eficiente el tráfico de datos. Mejoran la escalabilidad de la red, permiten agregar más usuarios, mejoran la velocidad de la red y administran transferencias de datos más grandes. Además, los conmutadores son importantes para agregar medidas de seguridad y optimizar los servicios en la nube.

Ejemplo: Conmutador de la serie Juniper QFX – QFX5120.

Los conmutadores admiten conexiones tanto por cable como inalámbricas y son compatibles con protocolos avanzados como EVPN-VXLAN, una combinación de protocolos de red privada virtual Ethernet (EVPN) con LAN extensible virtual (VXLAN).

En términos de funcionalidades específicas, los conmutadores Ethernet se utilizan para la integración de servicios en la nube y la gestión del tráfico a través de capas centrales y de agregación de redes de centros de datos. Además, los conmutadores de red programables ofrecen la ventaja de una programabilidad abierta y una automatización de extremo a extremo, lo que los hace ideales para construir arquitecturas de columna vertebral.

Enrutadores

Los enrutadores son dispositivos de red que dirigen el tráfico de datos entrante y saliente entre diferentes redes, asegurando que los paquetes de datos lleguen a sus destinos de manera eficiente. Estos dispositivos mantienen operaciones consistentes y mejoran los sistemas de red de centros de datos existentes.

Ejemplo: Plataforma de enrutamiento universal Juniper MX304.

Los enrutadores se pueden diseñar con compatibilidad para software de automatización y sistemas operativos específicos. Algunos enrutadores están equipados con capacidades de redes definidas por software (SDN), lo que los hace adaptables a las crecientes demandas. Otros se centran en ofrecer características fundamentales con alta eficiencia, como ofrecer capacidad de 100G y 400G en redes de centros de datos.

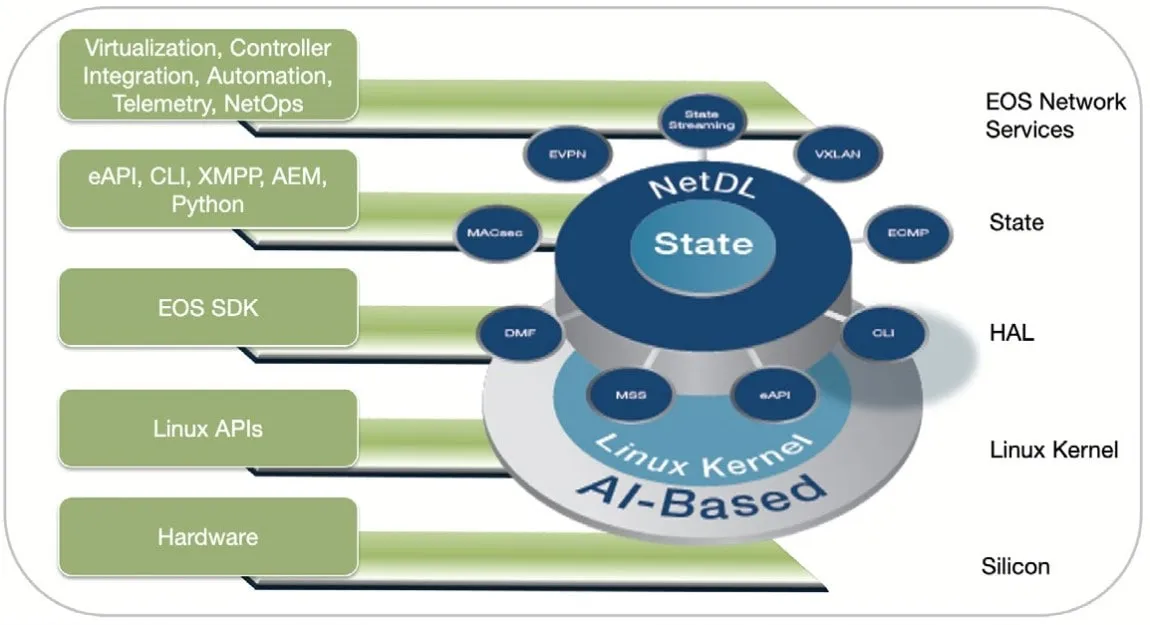

sistemas operativos

Los sistemas operativos de red de centros de datos sirven como plataformas de software que administran recursos de hardware y brindan servicios para diversas aplicaciones informáticas. Estos sistemas están estandarizados en todo el espectro de hardware de una empresa, lo que garantiza una conectividad constante entre diversos dispositivos. Al emplear análisis en tiempo real, pueden mejorar dinámicamente el rendimiento.

Ejemplo: Sistema operativo extensible Arista (EOS).

Los atributos claves de dichos sistemas operativos son:

- Integración con marcos de automatización: Los sistemas operativos son compatibles con Múltiples marcos de automatización, incluidos Ansible, Chef, Puppet, PyEZ y Salt, lo que les permite integrarse con diferentes infraestructuras.

- Programabilidad personalizable: Equipados con un kit de herramientas API, los sistemas operativos permiten a los operadores adaptar el sistema de acuerdo con los requisitos comerciales específicos. Esta personalización incluye la gestión del acceso a la red y el control de los servicios del plano de datos.

- Capacidades de telemetría: Los sistemas operativos a menudo incorporan una interfaz de telemetría equipada con motores de análisis de redes distribuidas. Estos motores agregan, estructuran y presentan datos y detalles de eventos en tiempo real, ayudando así a los operadores tanto en la optimización de la red actual como en la planificación futura.

Protocolos

Los protocolos de red de centros de datos son esenciales para la comunicación y la gestión dentro y entre centros de datos. Estos protocolos garantizan que el tráfico de datos se enrute de forma eficiente, que los paquetes de datos se monten y desmonten correctamente y que las redes de los centros de datos puedan escalar para adaptarse a la demanda. Estos son algunos de los protocolos de red de centros de datos más comunes:

Protocolos de capa de red y transporte

- Ethernet: Estándar para la comunicación de la red del centro de datos mediante cables. Además, Ethernet puede facilitar conexiones cruzadas al vincular los equipos de diferentes clientes mediante cables físicos.

- IP (Protocolo de Internet): Reglas para rutar paquetes a través de redes e Internet

- InfiniBand: Un estándar de red de alta velocidad y baja latencia, utilizado para computación de alto rendimiento (HPC) y computación acelerada

Protocolos de almacenamiento

- Fibre Channel: Tecnología de red de alta velocidad utilizada principalmente para redes de almacenamiento.

- iSCSI (Interfaz de sistemas informáticos pequeños de Internet): Transporta datos de almacenamiento a nivel de bloque a través de redes IP

- FCoE (Fibre Channel over Ethernet): Transmite datos de Fibre Channel a través de redes Ethernet

Protocolos de aplicación y enrutamiento

- HTTP/HTTPS (Protocolo de Transferencia de Hipertexto/Seguro): Protocolos para transmitir contenido web. Los balanceadores de carga los utilizan comúnmente para distribuir solicitudes y para una transmisión de datos eficiente.

- BGP (Border Gateway Protocol): Protocolo para intercambiar información de enrutamiento entre gateways de red. Se utiliza para gestionar cómo se envían los paquetes a través de Internet y entre diferentes centros de datos.

Protocolos de virtualización de red

- VXLAN (LAN virtual extensible): Mejora la escalabilidad en redes virtualizadas, particularmente para grandes implementaciones de computación en la nube.

- VLAN (red de área local virtual): Se utiliza para segmentar una red de centro de datos físicos en Múltiples redes lógicas aisladas.

Estrategias y modelos operativos en redes de centros de datos

Las redes de centros de datos requieren enfoques de gestión especializados y estrategias operativas para manejar entornos complejos y dinámicos de manera eficiente. Estas estrategias comprenden sistemas automatizados, recursos centralizados y tecnologías de redes definidas por software (SDN).

Automatización y redes basadas en intenciones.

Las redes basadas en intenciones (IBN) representan un cambio de paradigma en la gestión de redes, al introducir un mayor nivel de automatización. Utiliza software para traducir los objetivos comerciales en políticas de red, que se implementan automáticamente en toda la infraestructura de la red. Estas políticas se aplican como configuraciones específicas para cada dispositivo en varios proveedores de hardware, topologías de red y ubicaciones de centros de datos.

La gestión de redes de centros de datos en instalaciones modernas está cada vez más impulsada por este software de automatización porque simplifica las tareas administrativas, mejora la seguridad y mejora la eficiencia operativa. El software IBN también proporciona monitoreo y análisis, lo que permite una rápida identificación y resolución de problemas al tiempo que garantiza un cumplimiento continuo con los estándares organizacionales.

Las características clave incluyen aprovisionamiento sin intervención (ZTP), información predictiva y funciones de reversión en toda la red, que en conjunto reducen los tiempos de configuración, evitan posibles interrupciones y minimizan los errores humanos.

Centralización en redes de centros de datos

La centralización juega un papel crucial en la mejora del control y la capacidad de administración dentro de las soluciones de redes de centros de datos. Es importante distinguir entre la centralización física de los recursos de hardware y la centralización lógica de la gestión de la red.

Centralización física versus lógica

- Centralización física: Implica consolidar recursos de computación, almacenamiento y redes dentro de una o un número limitado de ubicaciones de centros de datos. Este enfoque permite un control más estricto de los recursos, una seguridad mejorada y un mantenimiento más sencillo.

- Lógica de centralización: Se refiere al uso de tecnologías como redes definidas por software (SDN) para centralizar las funciones de control de la red, mientras los datos continúan fluyendo a través de rutas distribuidas. Este método mejora la flexibilidad, la escalabilidad y la capacidad de respuesta de la red del centro de datos ante las cambiantes necesidades empresariales.

Función de las redes definidas por software (SDN)

SDN es parte integral de las operaciones de red de los centros de datos modernos, lo que permite la centralización de las funciones de control e inteligencia de la red. Al desacoplar el plano de control de la red del plano de datos (reenvío), SDN permite una gestión y automatización de la red más ágil. Esta adaptabilidad es crucial para manejar cargas de trabajo dinámicas, optimizar la asignación de recursos y responder rápidamente a los requisitos comerciales en evolución.