Los centros de datos son fundamentales para muchas empresas que Elon Musk ha fundado, cofundado o en las que sigue teniendo una participación significativa, incluidas Tesla, X Corp (Twitter) y xAI. Estas empresas dependen de los centros de datos para procesar, almacenar y analizar grandes cantidades de datos operativos y generados por los usuarios. Esta infraestructura respalda sus servicios principales, el desarrollo de inteligencia artificial y las interacciones en tiempo real con bases de usuarios globales.

Las empresas de Elon Musk (Tesla, X Corp (Twitter) y xAI) están desarrollando y operando centros de datos en todo el mundo. Las ubicaciones clave para estas instalaciones incluyen Austin, Texas; Chispas, Nevada; varios sitios en California; Atlanta, Georgia; Hillsboro, Oregón; Menfis, Tennessee; y Shanghái, China.

Centro Infra explora los centros de datos y la infraestructura informática detrás de las principales empresas de Elon Musk: Tesla, X Corp (Twitter) y xAI. Cubrimos los sistemas informáticos de alto rendimiento de Tesla, incluida su supercomputadora Dojo y su chip D1, la estrategia del centro de datos de X Corp y la infraestructura emergente de xAI para respaldar su chatbot de IA, Grok. Estos centros de datos son la columna vertebral que respalda las afirmaciones de Musk de que la inteligencia artificial general se puede lograr en dos años.

Centros de datos de Tesla y hardware de TI

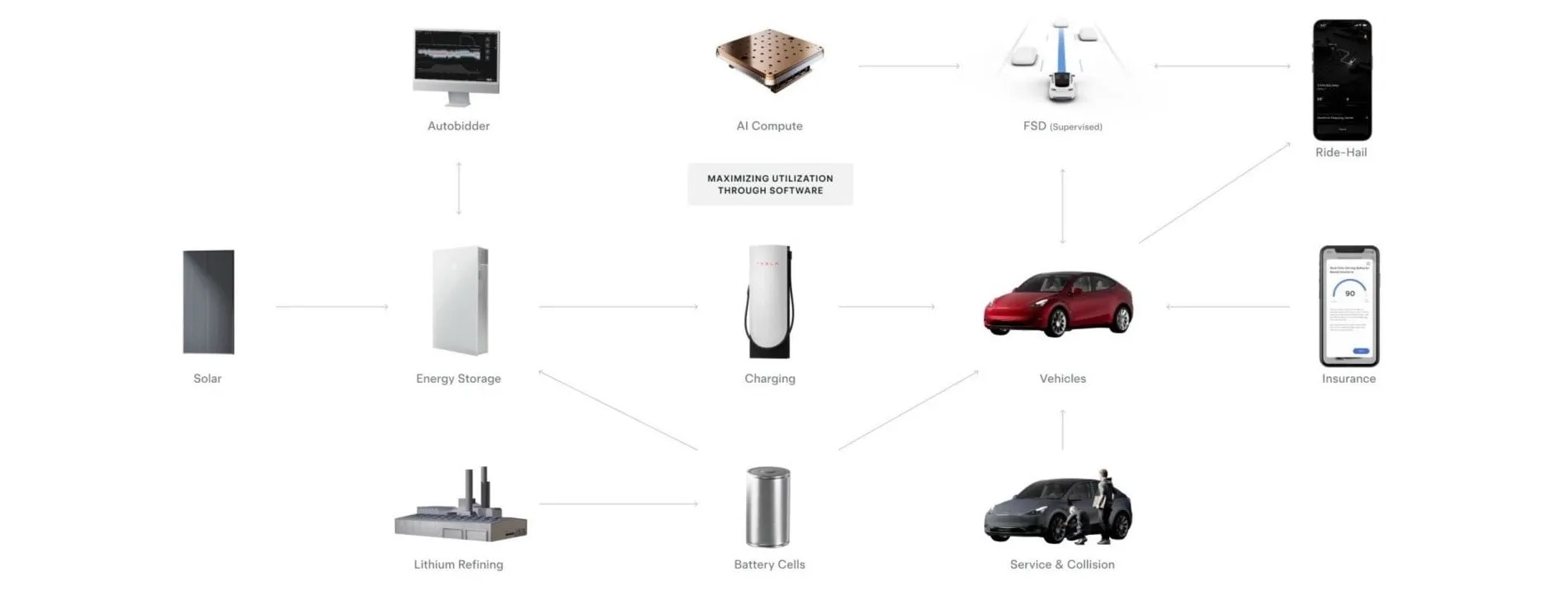

Tesla utiliza centros de datos para procesar y almacenar cantidades masivas de datos recopilados de sus millones de vehículos eléctricos (EV) en todo el mundo. Estos datos incluyen lecturas de sensores, comportamiento de conducción, rendimiento del piloto automático y actualizaciones de software inalámbricos. Estos recursos de computación y almacenamiento también impulsan la capacitación en inteligencia artificial de Tesla, que es esencial para desarrollar y perfeccionar su tecnología de conducción autónoma total (FSD). Además, los centros de datos de Tesla respaldan sus servicios a bordo basados en la nube para propietarios de vehículos, así como la aplicación móvil de Tesla.

Fuente: Tesla. Haga clic aquí para ver una versión más grande de esta imagen.

Más allá de la telemetría de vehículos y la capacitación en inteligencia artificial, los centros de datos de Tesla desempeñan un papel crucial en todo su ecosistema de productos y servicios. Alimentan su software de navegación interno, administran datos para los sistemas de baterías domésticas Powerwall y facilitan el acceso a la red Supercharger, que comprende estaciones de carga rápida para vehículos eléctricos Tesla.

Aceleradores informáticos de alto rendimiento

Dentro de sus centros de datos, Tesla implementa una combinación de aceleradores informáticos de alto rendimiento. Esta computación acelerada incluye GPU NVIDIA dispuestas en clústeres y chips D1 personalizados de Tesla, diseñados específicamente para el entrenamiento de IA. Los chips D1 son un componente crítico de la supercomputadora Dojo de Tesla.

Fuente: Tesla.

Clústeres de GPU

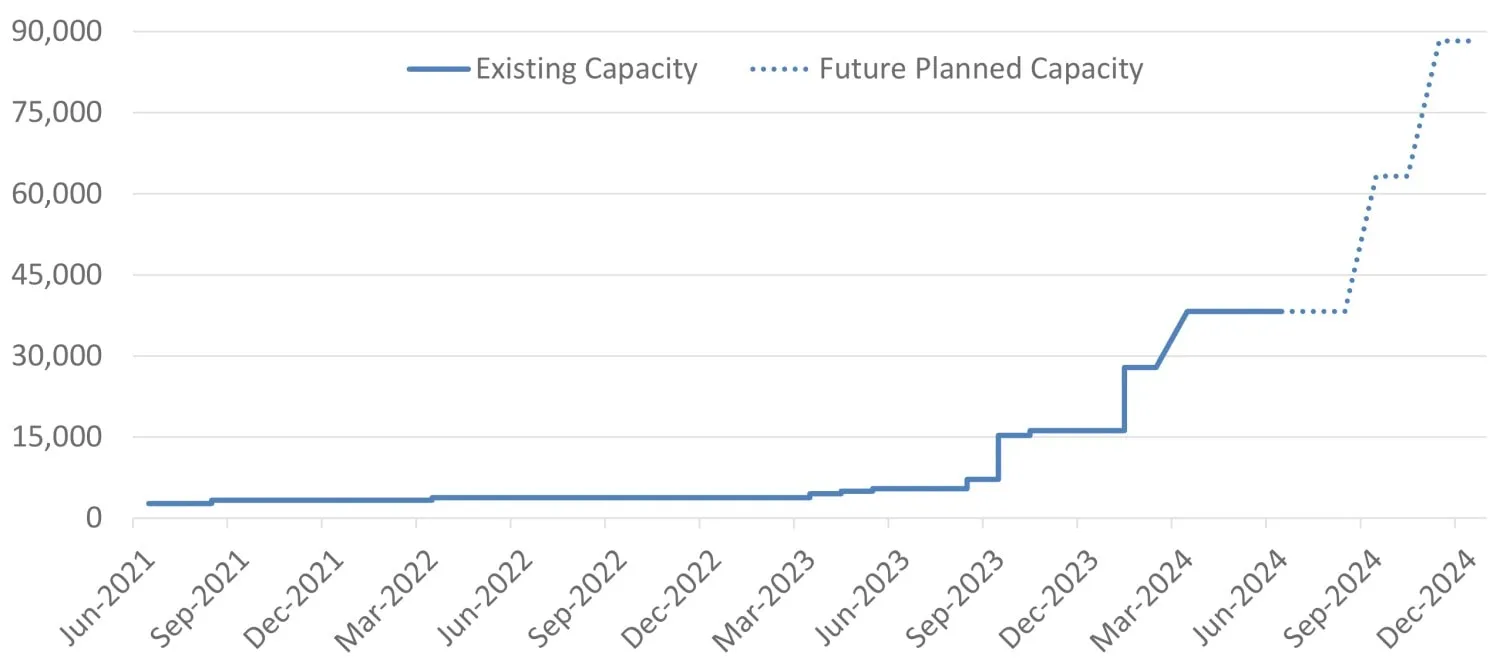

Hasta la fecha, Tesla ha instalado y puesto en funcionamiento más de 35.000 GPU NVIDIA H100 para su grupo de entrenamiento de IA para vehículos autónomos, que se utiliza para desarrollar su tecnología Full Self-Driving (FSD). Para finales de 2024, Tesla planea aumentar su capacidad a casi 90.000 GPU equivalentes a NVIDIA H100 para finos entrenamiento de IA.

Capacidad de entrenamiento de IA de Tesla: GPU equivalente a un H100

Fuente: Tesla.

En 2024, Elon Musk supuestamente ordenó a NVIDIA que enviara las GPU reservadas para Tesla (por un total de más de 500 millones de dólares en reservas) a X Corp (Twitter) y xAI. Musk afirmó que Tesla carecía de la infraestructura para usar las GPU en ese momento, por lo que habrían permanecido almacenadas sin usar.

Supercomputadora Dojo y chips D1

Dojo es una supercomputadora desarrollada a medida por Tesla para manejar cargas de trabajo de aprendizaje automático a gran escala y procesar petabytes (millas de terabytes) de datos de video recopilados de los vehículos eléctricos (EV) de Tesla. Estos datos se utilizan para entrenar redes neuronales de manera más eficiente, que son cruciales para mejorar el rendimiento del software Full Self-Driving (FSD) de Tesla.

Fuente: Tesla.

Tesla pretende superar las capacidades de las GPU tradicionales con Dojo, utilizando chips D1 personalizados diseñados específicamente para el entrenamiento de IA. Elon Musk ha declarado que Tesla va a “doblar su apuesta” en el desarrollo de su supercomputadora Dojo, con planes de invertir más de mil millones de dólares en su desarrollo. Esta inversión incluye costos de I+D para los chips y gastos del centro de datos.

En una escala más amplia, Tesla anticipa ganar más de $10 mil millones en gastos de capital (CapEx) en 2024.

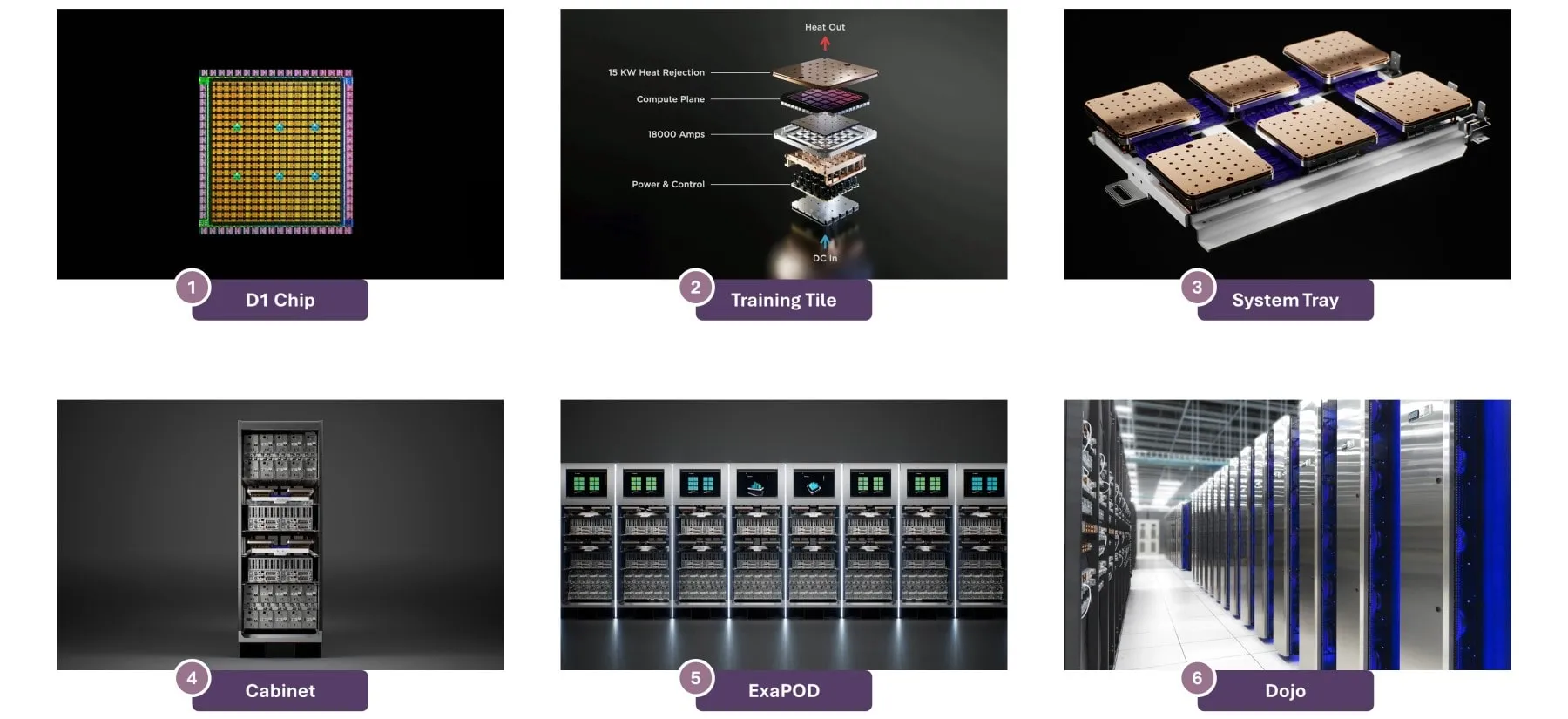

Componentes de la supercomputadora Dojo de Tesla

A continuación se muestra un desglose detallado de la arquitectura de hardware que soporta la supercomputadora Dojo de Tesla, comenzando con el componente más pequeño, el chip D1, y extendiéndose hasta la supercomputadora Dojo completa:

- Chip D1: Un chip de IA personalizado fundamental diseñado por Tesla específicamente para tareas de entrenamiento de IA. Cada chip D1 tiene una capacidad de procesamiento de 362 teraflops (TFLOPS)

- Mosaico de entrenamiento: Un grupo de 25 chips D1 trabajando juntos, dispuestos en una configuración de 5×5. El mosaico de entrenamiento puede alcanzar hasta 9 petaflops (PFLOPS) de potencia de procesamiento.

- Bandeja del sistema: Contiene 6 mosaicos de entrenamiento combinados en un solo tablero. La bandeja del sistema puede alcanzar hasta 54 petaflops (PFLOPS) de potencia informática.

- Gabinete: Alberga 2 bandejas del sistema con fuentes de alimentación redundantes, que proporcionan hasta 108 petaflops (PFLOPS) de potencia de procesamiento. Los gabinetes también contienen ensamblajes clave, incluidos los procesadores de interfaz Dojo: memoria para entrenamiento (32 GB de DRAM de alto ancho de banda) y memoria desagregada (640 GB de DRAM de alto ancho de banda), así como la interfaz de host Dojo (512 núcleos x86 en total)

- ExaPOD: Una colección de 10 gabinetes, que representan 1,1 exaFLOPS (quintillones de operaciones de punto flotante por segundo) de potencia informática.

- Supercomputadora Dojo: La configuración inicial de la supercomputadora Dojo de Tesla albergaba alrededor de 3000 chips D1, que comprendían mosaicos de entrenamiento (25 chips D1), bandejas del sistema (6 mosaicos de entrenamiento), gabinetes (2 bandejas del sistema) y 10 gabinetes que forman un ExaPOD. La arquitectura modular de Dojo permite combinar Múltiples ExaPOD como bloques de construcción para ampliar aún más el sistema Dojo.

Haga clic aquí para ver una versión más grande de esta imagen.

La supercomputadora Dojo de Tesla está diseñada para interconectarse y ampliarse para lograr un entrenamiento de redes neuronales de alto rendimiento, gran ancho de banda y baja latencia. La compañía afirma que Dojo puede reducir algunos tiempos de entrenamiento de IA de un mes a una semana.

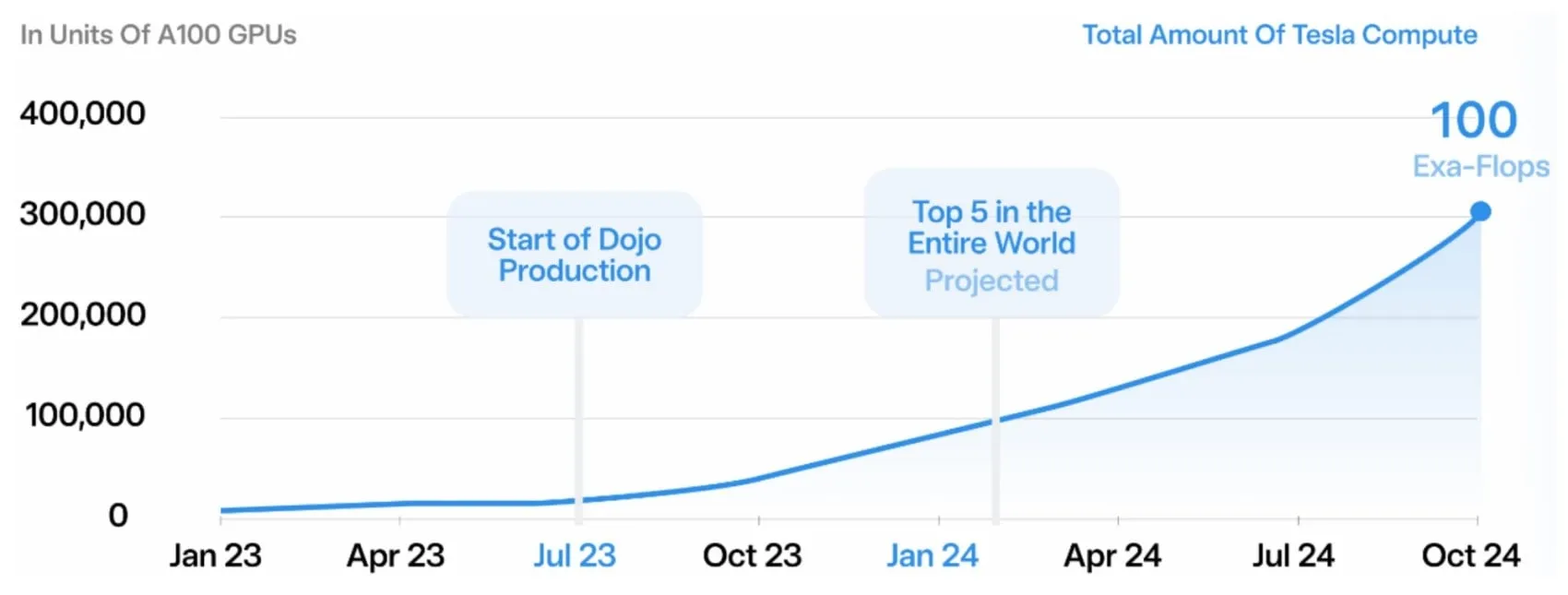

Para fines de 2024, Dojo 1 tendrá el equivalente a aproximadamente 8000 GPU NVIDIA H100 en línea, y Tesla apunta a lograr 100 exaFLOPS de capacidad interna de entrenamiento de redes neuronales.

Proyección interna de Tesla de la potencia informática de Dojo

Fuente: Tesla.

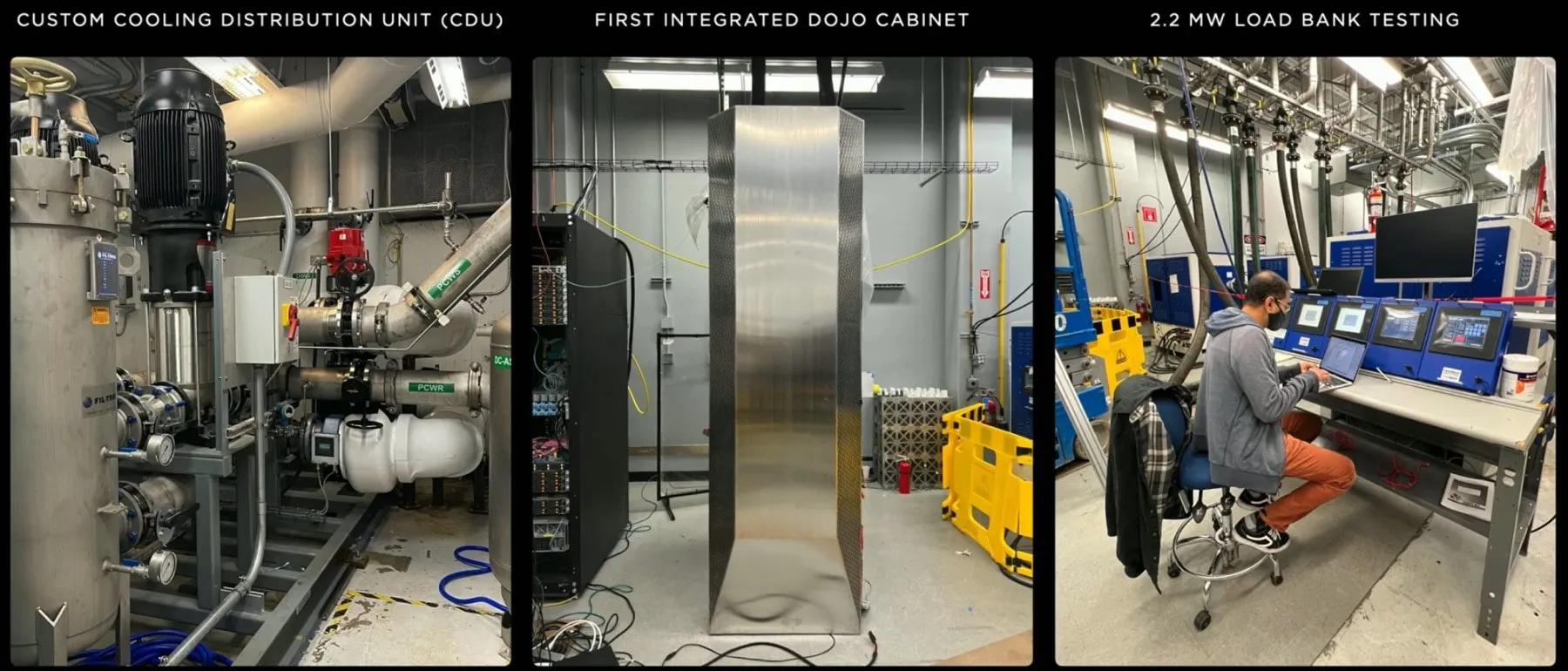

Energía y refrigeración para la supercomputadora Dojo de Tesla

La potencia y la refrigeración adecuadas son cruciales para la supercomputadora Dojo de Tesla debido a sus componentes densamente empaquetados y de alto rendimiento, incluidos los chips D1 y los ExaPOD. Esta infraestructura de TI requiere una potencia significativa y genera un calor inmenso durante las tareas intensivas de entrenamiento de IA. Es necesaria una gestión eficiente de este calor para ofrecer un rendimiento óptimo y mitigar los fallos del hardware.

Fuente: Tesla.

Dojo admite densidades de energía de más de 200 kilovatios (kW) por gabinete (y megavatios para un ExaPOD). Para cumplir con sus densos requisitos de enfriamiento, Dojo utiliza una unidad de distribución de enfriamiento (CDU) personalizada, como se muestra arriba.

Ubicaciones de centros de datos

Tesla opera y está desarrollando varias ubicaciones de centros de datos estratégicos en Estados Unidos e internacionalmente para respaldar sus necesidades informáticas avanzadas.

Austin, Texas

Tesla está construyendo una nueva supercomputadora Dojo en su sede en Austin, Texas, para albergar su grupo de entrenamiento de IA más grande hasta la fecha. Ubicado junto a sus instalaciones de fabricación de automóviles en Giga Texas, este nuevo grupo de supercomputadoras se encuentra actualmente en construcción (aunque con retraso) y contará con una configuración refrigerada por agua.

Actualmente, Tesla está trasladando los racks de servidores GPU H100 a la recién terminada extensión sur de Giga Texas. El grupo de entrenamiento de IA incluye 2.000 GPU NVIDIA H100 y 20.000 computadoras AI5 de Tesla. En última instancia, la extensión sur de Giga Texas albergará un clúster de 50.000 GPU NVIDIA H100, que ayudará a avanzar en la tecnología de conducción autónoma total (FSD) de Tesla.

Reno (Sparks), Nevada

Tesla ha establecido un centro de datos en su Gigafactory Nevada, una fábrica de componentes para vehículos eléctricos (EV) y baterías de iones de litio en Sparks, Nevada, en las afueras de Reno, en el condado de Storey. Además, Tesla es cliente de Switch, Inc en el Citadel Campus de la compañía, ubicado junto a Gigafactory Nevada en Sparks. Switch, Inc también comparte un parque solar con Tesla en el área.

San José, California

Tesla opera una supercomputadora Dojo en San José, California. Además, Tesla planea instalar 7 ExaPOD en Palo Alto, California, que es un centro para las actividades de ingeniería e investigación y desarrollo de la compañía. Esta implementación aumentaría potencialmente las capacidades de Tesla a 8,8 exaFLOPS de potencia informática (frente a los 1,1 exaFLOPS actuales).

Sacramento, California

Tesla alquila un centro de datos en Sacramento, California, a NTT Global Data Centers, que X Corp (anteriormente Twitter) desalojó anteriormente. La empresa utiliza la capacidad de este centro de datos para cargas de trabajo de aprendizaje automático, incluidas simulaciones de vehículos autónomos.

Shanghái, China

Tesla opera un centro de datos en Shanghai, China, para cumplir con las regulaciones chinas que exigen el almacenamiento de datos local. La compañía almacena localmente todos los datos generados por las ventas de vehículos en China continental, atendiendo las preocupaciones de las autoridades chinas sobre posibles riesgos de seguridad.

GDS Holdings, el mayor operador de centros de datos neutrales para el operador (/articulos/carrier-neutral-data-centers/) de China, ha declarado que Tesla es uno de sus clientes. En total, GDS opera 28 instalaciones en Shanghai y la zona del delta del Yangtze.

Centros de datos de X Corp (Twitter)

X Corp (anteriormente Twitter) utiliza centros de datos para almacenar y procesar grandes cantidades de datos de usuarios, incluidos tweets, mensajes directos y cargas de medios. Estos centros de datos también impulsan los algoritmos de la plataforma para la recomendación de contenido, el análisis de tendencias y la orientación de publicidad, lo que permite que el servicio gestione millones de interacciones en tiempo real a nivel mundial.

Desde la adquisición de Twitter por 44.000 millones de dólares por parte de Elon Musk en octubre de 2022, la empresa ha estado racionalizando su infraestructura de TI mediante:

- Cierre y reducción de centros de datos.

- Reducir la capacidad del servidor

- Reducir el gasto en la nube

A pesar de estas reducciones, X Corp ha aumentado la capacidad de su acelerador informático de alto rendimiento. La compañía compró recientemente 10.000 GPU NVIDIA para el desarrollo de inteligencia artificial, con el objetivo de construir clústeres de supercomputación de GPU locales.

En Estados Unidos, X Corp opera centros de datos en varias ubicaciones clave:

atlanta, georgia

X Corp alquila capacidad en las instalaciones de QTS Data Centers en el área metropolitana de Atlanta, Georgia. Un centro de datos notable incluye el centro de datos Atlanta 1 DC1 de QTS ubicado en 1033 Jefferson Street NW:

Fuente: Centros de datos QTS.

Además, en el centro de datos Atlanta 1 DC2 de QTS, ubicado en 1025 Jefferson Street NW, X Corp recibió una exención fiscal de 10,1 millones de dólares durante 10 años como parte de un proyecto de 700 millones de dólares para implementar equipos de TI y hardware de inteligencia artificial en las instalaciones. A continuación se muestra el Atlanta 1 DC2 de QTS:

Fuente: Centros de datos QTS.

Sin embargo, X Corp también redujo recientemente el tamaño de una instalación no revelada en Atlanta.

Portland (Hillsboro), Oregón

X Corp alquila más de 50 megavatios (MW) de capacidad de energía en centros de datos propiedad de Digital Realty en Hillsboro, Oregón, un suburbio al oeste de Portland. Oregón tiene abundante energía hidroeléctrica, que proporciona electricidad de bajo costo ($0,05 a $0,07 por kWh) y respetuosa con el medio ambiente para los centros de datos.

Sacramento, California – Salido

Como parte de su racionalización de infraestructura de TI, X Corp abandonó una instalación propiedad de NTT Global Data Centers en Sacramento, California, cuando expiró su contrato de arrendamiento. Posteriormente, Tesla se hizo cargo de parte del [espacio del centro de datos] desocupado(/articulos/data-center-tiers-difference-1-2-3-4space/).

X Corp también salió de otra instalación de Sacramento propiedad de Prime Data Centers. Esta instalación colapsó anteriormente en septiembre de 2022 durante una ola de calor en California.

En general, X Corp reclama 100 millones de dólares en ahorros anuales al salir de sus centros de datos de Sacramento. La salida liberó 48 MW de capacidad e implicó reubicar 5.200 racks y 148.000 servidores.

Proveedores de servicios en la nube (CSP)

X Corp tiene contratos de varios años con proveedores de servicios en la nube, incluidos Amazon Web Services (AWS), Google Cloud y Oracle Nube. Sin embargo, la empresa ha informado de una reducción del 60% en sus costos mensuales de la nube mediante la repatriación de cargas de trabajo. También redujo el tamaño de su almacenamiento de datos en la nube en un 60% y los costos de procesamiento de datos en la nube en un 75%.

Centros de datos xAI

xAI es una [empresa] de inteligencia artificial (https://x.ai/) fundada por Elon Musk en 2023 con el objetivo de desarrollar sistemas avanzados de inteligencia artificial para comprender la verdadera naturaleza del universo. La compañía tiene como objetivo crear “una buena AGI” (Inteligencia General Artificial) y ha lanzado un chatbot de IA y un modelo de lenguaje llamado Grok.

En mayo de 2024, xAI recaudó 6 mil millones de dólares en capital, valorando la empresa en 24 mil millones de dólares. Además, Elon Musk está buscando actualmente la aprobación de la junta directiva de Tesla para una inversión de 5 mil millones de dólares en xAI.

xAI utiliza centros de datos para proporcionar la potencia computacional y el almacenamiento necesarios para entrenar y ejecutar su chatbot de IA, Grok. Estos centros de datos manejan tareas como entrenar el modelo de lenguaje grande con datos de usuarios de X Corp (Twitter), ejecutar inferencias y almacenar grandes cantidades de datos. Además, Elon Musk ha mencionado posibles oportunidades para integrar Grok en el software de Tesla.

xAI lanzó Grok-1.5 y actualmente está entrenando Grok-2 utilizando 20.000 GPU NVIDIA H100. Elon Musk estima que Grok-3 requerirá 100.000 GPU. Con este fin, los planos a corto plazo de xAI para centros de datos incluyen:

- Implementar un clúster de entrenamiento de 100.000 GPU NVIDIA H100 refrigeradas por líquido antes de finales de 2024.

- Agregar otro clúster de GPU NVIDIA B200 (Blackwell) a partir del verano de 2025

Menfis (Tennessee)

xAI planea construir la supercomputadora más grande del mundo, llamada “Gigafábrica de Computación”, en Memphis, Tennessee. Esta supercomputadora estará alojada en un centro de datos de 150 megavatios (MW) ubicado en un parque industrial cerca del río Mississippi en el suroeste de Memphis. Específicamente, el centro de datos ocupará una antigua planta de Electrolux de 750.000 pies cuadrados en el área de Boxtown en el sur de Memphis.

Fuente: xAI.

Elon Musk pretende que las nuevas instalaciones de xAI estén en pleno funcionamiento para el otoño de 2025, lo que representa una inversión multimillonaria en Memphis. Como parte de este compromiso, xAI planea gastar $24 millones en una nueva subestación y ha asegurado un compromiso de 150 MW de capacidad de energía de Memphis Light, Gas and Water (MLGW) para fines de 2024.

Conocido también como Memphis Supercluster, el sistema utilizará una única estructura de acceso remoto directo a memoria (RDMA) para conectar hasta 100.000 GPU NVIDIA H100. Dell y Supermicro suministran los servidores para la supercomputadora Memphis de xAI.

Proveedores de servicios en la nube (CSP)

Oracle Cloud proporciona una parte importante de la infraestructura de capacitación en IA existente de xAI:

- xAI alquila actualmente alrededor de 16.000 GPU NVIDIA H100 de Oracle Cloud

- xAI contrató 24.000 GPU NVIDIA H100 de Oracle Cloud para la capacitación de Grok-2

En julio de 2024, xAI supuestamente puso fin a las conversaciones sobre un compromiso plurianual de expansión de la IA por valor de 10.000 millones de dólares para comprar más capacidad de GPU/servidor de Oracle Cloud.

Además, xAI aprovecha los servicios en la nube de Amazon Web Services (AWS) y utiliza capacidad adicional en los centros de datos de X Corp (Twitter).