La IA generativa representa un avance tecnológico significativo, tras el auge de Internet, los dispositivos móviles y la computación en la nube. Sus beneficios prácticos inmediatos, especialmente en la mejora de la productividad y la eficiencia, son más evidentes que las de otras tecnologías emergentes como el metaverso, la conducción autónoma, blockchain y Web3. Los modelos de IA generativa se utilizan en muchos dominios, con ejemplos y aplicaciones notables de estos sistemas en áreas como la escritura, el arte y la música, entre otros campos innovadores.

La IA generativa es una tecnología transformadora que emplea redes neuronales para producir contenido original, incluidos texto, imágenes, videos y más. Aplicaciones conocidas como ChatGPT, Bard, DALL-E 2, Midjourney y GitHub Copilot demuestran la promesa inicial y el potencial de este avance.

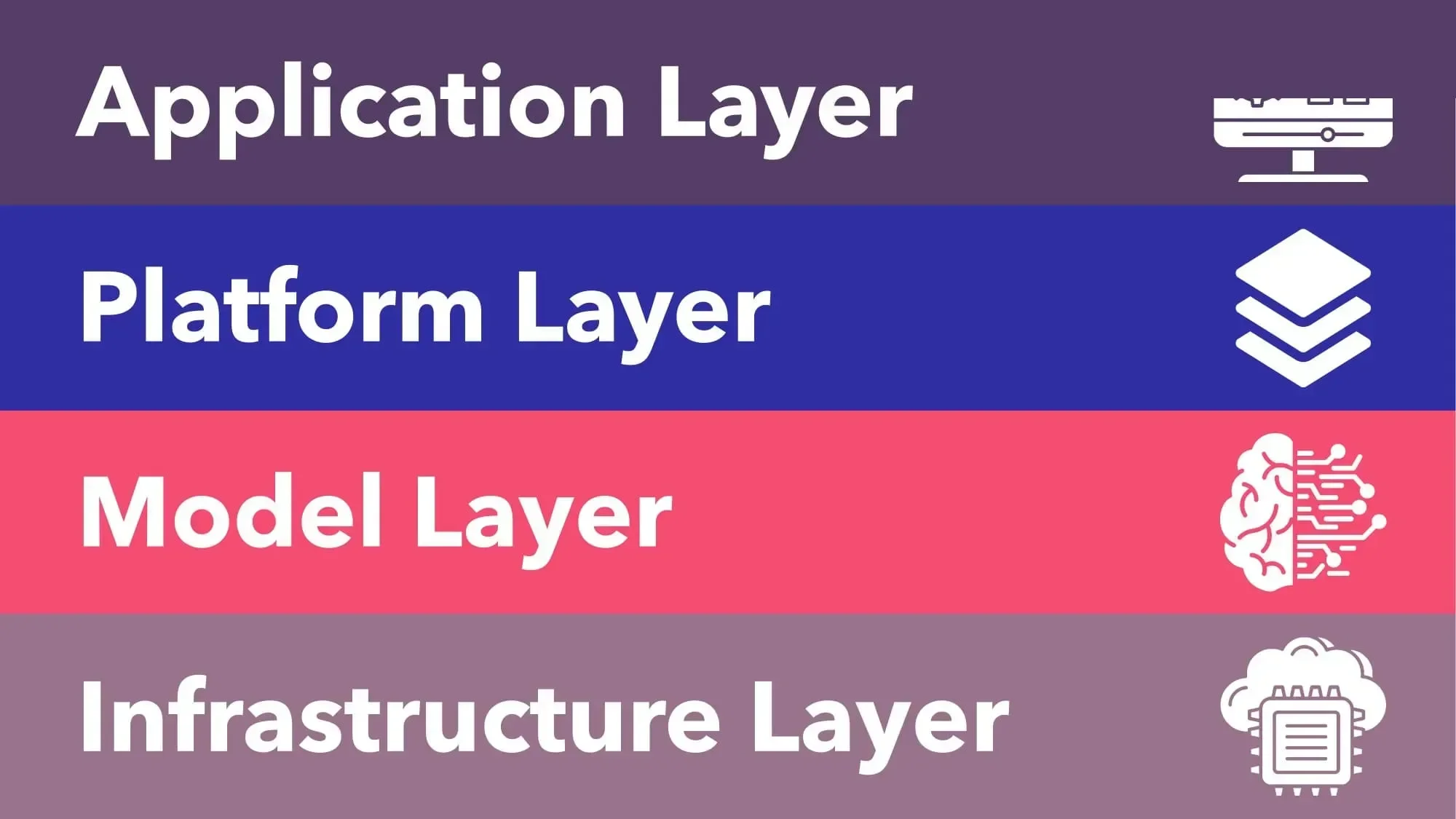

Sumérgete en el mundo en evolución de la IA generativa mientras exploramos sus mecánicas, ejemplos del mundo real, dinámica del mercado y las complejidades de sus múltiples “capas”, incluida la capa de aplicación, plataforma, modelo e infraestructura. Continúe leyendo para descubrir el potencial de esta tecnología, cómo está dando forma a las industrias y las capas que la hacen funcional y transformadora para los usuarios finales.

¿Qué es la IA generativa?

La IA generativa es un subconjunto de la inteligencia artificial que emplea algoritmos para crear contenido nuevo, como texto, imágenes, videos, audio, código de software, diseño u otras formas de contenido.

¿Cómo funciona la IA generativa?

Los modelos de IA generativa funcionan utilizando redes neuronales para analizar e identificar patrones y estructuras dentro de los datos con los que han sido entrenados. Utilizando este conocimiento, genera contenido nuevo que imita creaciones similares a las humanas y amplía el patrón de sus datos de entrenamiento. La función de estas redes neuronales varía según la tecnología o arquitectura específica utilizada. Esto incluye, entre otros, transformadores, redes generativas adversas (GAN), codificadores automáticos variacionales (VAE) y modelos de difusión.

- Transformadores: Los transformadores utilizan mecanismos de autoatención para procesar y analizar secuencias de datos con mayor eficiencia que los métodos convencionales. A diferencia de los modelos de IA tradicionales que solo se centran en oraciones individuales, los transformadores pueden identificar conexiones entre palabras en páginas, capítulos o libros completos. Esto los hace muy adecuados para el entrenamiento en conjuntos de datos masivos y sin etiquetar.

- Redes generativas adversarias (GAN): Las GAN se componen de dos partes: un generador que crea nuevos datos y un discriminador que distingue entre datos reales y generados por computadora. Ambos componentes se entrenan simultáneamente. El generador es penalizado si produce muestras poco realistas, mientras que el discriminador es penalizado si identifica incorrectamente ejemplos generados por computadora.

- Autocodificadores variacionales (VAE): Los VAE consisten en un codificador y un decodificador que están conectados por un conjunto de variables latentes. Estos modelos de aprendizaje no supervisados se esfuerzan por hacer que la entrada y la salida sean lo más idénticos posibles comprimiendo el conjunto de datos en una forma simplificada. Las variables latentes permiten la generación de nuevos datos al introducir conjuntos aleatorios en el decodificador, lo que facilita la creatividad y la diversidad en la producción.

- Modelos de difusión: Estos modelos son algoritmos entrenados que manipulan datos agregando ruido aleatorio y luego eliminándolo hábilmente. Aprenderá a recuperar los datos originales a partir de versiones distorsionadas por ruido, lo que los hace especialmente útiles en aplicaciones de generación de imágenes. Al diseccionar los componentes de fotografías y obras de arte, los modelos de difusión son capaces de convertir ruido aleatorio en imágenes específicas y coherentes.

Comparación de las principales arquitecturas de modelos generativos.

Los transformadores se han convertido en la piedra angular del procesamiento del lenguaje natural y actualmente son la arquitectura más popular para los modelos de IA generativa. Les siguen las GAN, que se utilizan ampliamente en la síntesis y mejora de imágenes, los VAE, que se emplean combinados para la generación y reconstrucción de datos, y los modelos de difusión, que están ganando terreno por su capacidad para generar imágenes y texto de manera efectiva.

Ejemplos de IA generativa

Los modelos de IA generativa tienen la capacidad de crear contenido nuevo en diversas formas, como texto, imágenes, videos, audio, código de software y diseño. Aquí hay algunos ejemplos para cada categoría:

- Texto: La IA generativa puede producir texto similar al humano basándose en indicaciones específicas. Ejemplos destacados incluyen GPT de OpenAI (GPT-3.5 y GPT-4) y PaLM 2 de Google, que son grandes modelos de lenguaje (LLM) que impulsan chatbots populares como ChatGPT y Bard, respectivamente.

- Imágenes: Estos modelos pueden generar imágenes que van desde rostros humanos realistas y creaciones artísticas hasta escenas fotorrealistas, todo ello basado en descripciones textuales. Las aplicaciones notables en este campo son DALL-E 2, Adobe Firefly, Midjourney y Stable Diffusion de OpenAI.

- Videos: Aunque actualmente se limita a clips cortos, la IA generativa puede crear videos a partir de descripciones textuales. Las primeras plataformas en la generación de texto a video incluyen Kaiber, Runway, Genmo y Pika Labs

- Audio: La IA generativa es capaz de crear contenido de audio en forma de música y voz. Este proceso de creación puede guiarse por descripciones textuales, notación musical o archivos de audio iniciales. Para la generación de música, se utilizan ampliamente modelos como [MusicLM] de Google (https://blog.google/technology/ai/musiclm-google-ai-test-kitchen/), [MuseNet] de OpenAI (https://openai.com/research/musenet) y [AudioCraft] de Meta (https://audiocraft.metademolab.com/). En el campo de la conversión de texto a voz, modelos como [WaveNet] de Google DeepMind (https://www.deepmind.com/research/highlighted-research/wavenet), ElevenLabs y Tacotron son actualmente populares.

- Código de software: Existen herramientas de IA generativa que ayudan a los desarrolladores a indicar líneas o bloques completos de código mientras escriben, lo que mejora la productividad. Estas herramientas son compatibles con varios lenguajes de programación, incluidos Python, JavaScript, Java, C++ y otros. GitHub Copilot y Amazon CodeWhisperer son ejemplos de compañeros de codificación de IA populares

- Diseño: La IA generativa se emplea en la creación y optimización de modelos 3D, lo que facilita la creación de prototipos, agiliza la optimización de procesos y mejora el diseño de juegos a través de indicaciones basadas en texto. GET3D de NVIDIA, DreamFusion y RoomGPT son ejemplos de aplicaciones que pueden crear una amplia gama de diseños y activos relacionados.

ChatGPT y LLM: un ejemplo de clave de IA generativa

ChatGPT, utilizado por cientos de millones de personas en todo el mundo, es un ejemplo destacado de IA generativa. Puede producir texto similar al humano respondiendo a solicitudes de entrada, utilizando la arquitectura Transformer. Construido sobre los modelos GPT (Generative Pre-Trained Ttransformer) de OpenAI, ChatGPT es parte de la familia large language model (LLM) y se emplea propias para diversas tareas de procesamiento del lenguaje natural (NLP).

Los LLM son algoritmos de aprendizaje profundo capaces de reconocer, resumir, traducir, predecir y generar texto, junto con otro contenido. Estas habilidades se basan en conocimientos adquiridos a partir de amplios conjuntos de datos. En el caso de GPT-4, la arquitectura de la red neuronal, conocida como Transformer, alberga más de 1 billón de parámetros que sirvieron como base de entrenamiento. Los modelos GPT están diseñados para predecir la palabra siguiente en una secuencia de texto, mientras que el componente Transformer agrega contexto a cada palabra a través del mecanismo de atención.

Tamaño del mercado de la IA generativa

Boston Consulting Group (BCG) proyecta que el tamaño del mercado de IA generativa (https://www.bcg.com/capabilities/artificial-intelligence/generative-ai) alcanzará los 60 mil millones de dólares para 2025 y luego se duplicará a 120 mil millones de dólares para 2027. Este significativo aumento representa una tasa de crecimiento anual compuesto (CAGR) del 66% de 2022 a 2027. 2025, la IA generativa también Se espera que represente el 30% del mercado total de IA.

Estas sólidas cifras de crecimiento están respaldadas además por las [estimaciones] de McKinsey (https://www.mckinsey.com/capabilities/mckinsey-digital/our-insights/the-economic-potential-of-generative-ai-the-next-productivity-frontier) sobre el impacto económico más amplio de la IA generativa. Según su análisis, la IA generativa podría contribuir entre 2,6 y 4,4 billones de dólares al PIB (Producto Interno Bruto) en las economías avanzadas, lo que representa entre el 4% y el 7% del PIB general.

Capas de IA generativa

Para una comprensión más completa del panorama de la IA generativa, analizamos la cadena de valor de la tecnología, dividiéndola en cuatro capas interconectadas que trabajan juntas para crear contenido nuevo. Estas capas son la capa de aplicación, la capa de plataforma, la capa de modelo y la capa de infraestructura. Cada uno de ellos desempeña un papel distintivo en todo el proceso, mejorando las sólidas capacidades de la IA generativa.

Capa de aplicación de IA generativa

La capa de aplicación en la IA generativa agiliza la interacción humana con la inteligencia artificial al permitir la creación dinámica de contenido. Esto se logra a través de algoritmos especializados que ofrecen aplicaciones y servicios personalizados y automatizados de empresa a empresa (B2B) y de empresa a consumidor (B2C), sin que los usuarios necesiten acceder directamente a los modelos básicos subyacentes. El desarrollo de estas aplicaciones puede ser realizado tanto por los propietarios de los modelos básicos (como OpenAI con ChatGPT) como por empresas de software de terceros que incorporan modelos de IA generativa (por ejemplo, Jasper AI).

Aplicaciones generalizadas, específicas de dominio e integradas

La capa de aplicación de la IA generativa consta de tres subgrupos distintos: aplicaciones generalizadas, aplicaciones de dominio específico y aplicaciones integradas.

- Aplicaciones generalizadas: Esta categoría abarca software diseñado para realizar una amplia gama de tareas, generando contenido nuevo en diversas formas, incluidos texto, imágenes, videos, audio, código de software y diseño. Los ejemplos en esta categoría incluyen ChatGPT, DALL-E 2, GitHub Copilot, Character.ai (un servicio de chatbot que permite a los usuarios crear y conversar con personajes de IA) y Jasper AI (una herramienta de impulso de escritura por IA)

- Aplicaciones de dominio específico: Estas son soluciones de software diseñadas para satisfacer las necesidades y requisitos particulares de industrias específicas, como finanzas, atención médica, fabricación y educación. Estas aplicaciones son más especializadas y receptivas en sus respectivos dominios, especialmente cuando las empresas las capacitan con datos de alta calidad, únicos y patentados. Los ejemplos incluyen BloombergGPT, un LLM desarrollado por Bloomberg para análisis de datos financieros, y [Med-PaLM 2] de Google(https://sites.research.google/med-palm/), un LLM capacitado en datos médicos para responder consultas médicas.

- Aplicaciones integradas: Este subgrupo está formado por soluciones de software existentes que han incorporado funcionalidad de IA generativa para mejorar sus ofertas principales. Los principales actores incluyen Microsoft 365, Salesforce CRM y Adobe Creative Cloud. Ejemplos de herramientas de IA generativa integradas son Microsoft 365 Copilot (un asistente impulsado por IA para varios productos de Microsoft), [Einstein GPT] de Salesforce (https://www.salesforce.com/products/einstein/overview/) (una tecnología CRM de IA generativa) y la IA generativa de Adobe integraciones con Photoshop

Capa de plataforma de IA generativa

La capa de plataforma de la IA generativa se centra en brindar acceso a grandes modelos de lenguaje (LLM) a través de un servicio administrado. Este servicio simplifica el ajuste y la personalización de modelos básicos previamente entrenados y de uso general, como GPT de OpenAI. Aunque los líderes LLM, como GPT-4, pueden responder la mayoría de las preguntas inmediatamente después de la implementación utilizando solo el conjunto de datos bloqueados en el que han sido capacitados, el ajuste fino permite mejorar significativamente las capacidades de estos LLM para dominios de contenido específicos.

El ajuste implica desbloquear la red neuronal de un LLM existente para capas adicionales de entrenamiento con nuevos datos. Los usuarios finales o las empresas pueden integrar sin problemas sus propios datos de propiedad o específicos del cliente en estos modelos para aplicaciones específicas.

El objetivo final de la capa de plataforma es simplificar el uso de LLM para usuarios finales o empresas y reducir los costos asociados. Este enfoque elimina la necesidad de invertir millas de millones de dólares y años de esfuerzo en desarrollar estos modelos de forma independiente desde cero. En su lugar, los usuarios pueden pagar tarifas de suscripción mensuales o incluirlas en paquetes con sus ofertas de Infraestructura como servicio (IaaS). Además de esto, los usuarios también obtienen acceso a funciones valiosas como seguridad, privacidad y diversas herramientas de la plataforma, todas administradas de manera optimizada.

Plataformas en la nube para el ajuste del modelo de IA

Los proveedores de servicios en la nube (CSP) han desarrollado servicios de plataforma para permitir a las empresas acceder a los modelos básicos necesarios y entrenar y personalizar sus propios modelos para aplicaciones específicas. Los servicios de la plataforma incluyen:

- Servicio Azure OpenAI: Este servicio basado en la nube ofrece acceso a los modelos básicos de OpenAI, lo que permite a los usuarios crear aplicaciones dentro del portal de Azure. Se incluyen la familia GPT de LLM para generación de texto y Codex para generación de código.

- Amazon Bedrock: Una plataforma que admite la creación y el escalado de aplicaciones de IA generativa, utilizando modelos básicos como Claude de Anthropic, Stable Diffusion de Stability AI y Amazon Titan.

- Vertex AI de Google Cloud: Una plataforma de aprendizaje automático administrada que ofrece herramientas y servicios para crear, entrenar e implementar modelos de IA generativos, incluidos PaLM para generación de texto e Imagen para generación de imágenes.

Plataformas de código abierto para el ajuste del modelo de IA

También se encuentran disponibles soluciones de código abierto para ayudar en el ajuste y la personalización de modelos de base de uso general y previamente entrenados. Estos incluyen:

- Hugging Face: Reconocido como un “centro de modelos”, Hugging Face otorga acceso a más de 120 000 modelos de transformadores previamente entrenados y proporciona herramientas para ajustarlos para tareas de PNL como preguntas y respuestas, clasificación de texto y generación de texto.

- TensorFlow: Creada por Google, TensorFlow es una biblioteca de código abierto para el aprendizaje profundo. Facilita la construcción, el entrenamiento y la implementación de modelos de IA, con funciones de reconocimiento de imágenes, traducción automática y diversas aplicaciones de toma de decisiones.

- PyTorch: Desarrollado por Meta (anteriormente Facebook) Research, PyTorch es un marco de aprendizaje automático basado en Python. Es único por su fuerte soporte de GPU y la capacidad de modificar modelos en tiempo real mediante la diferenciación automática en modo inverso.

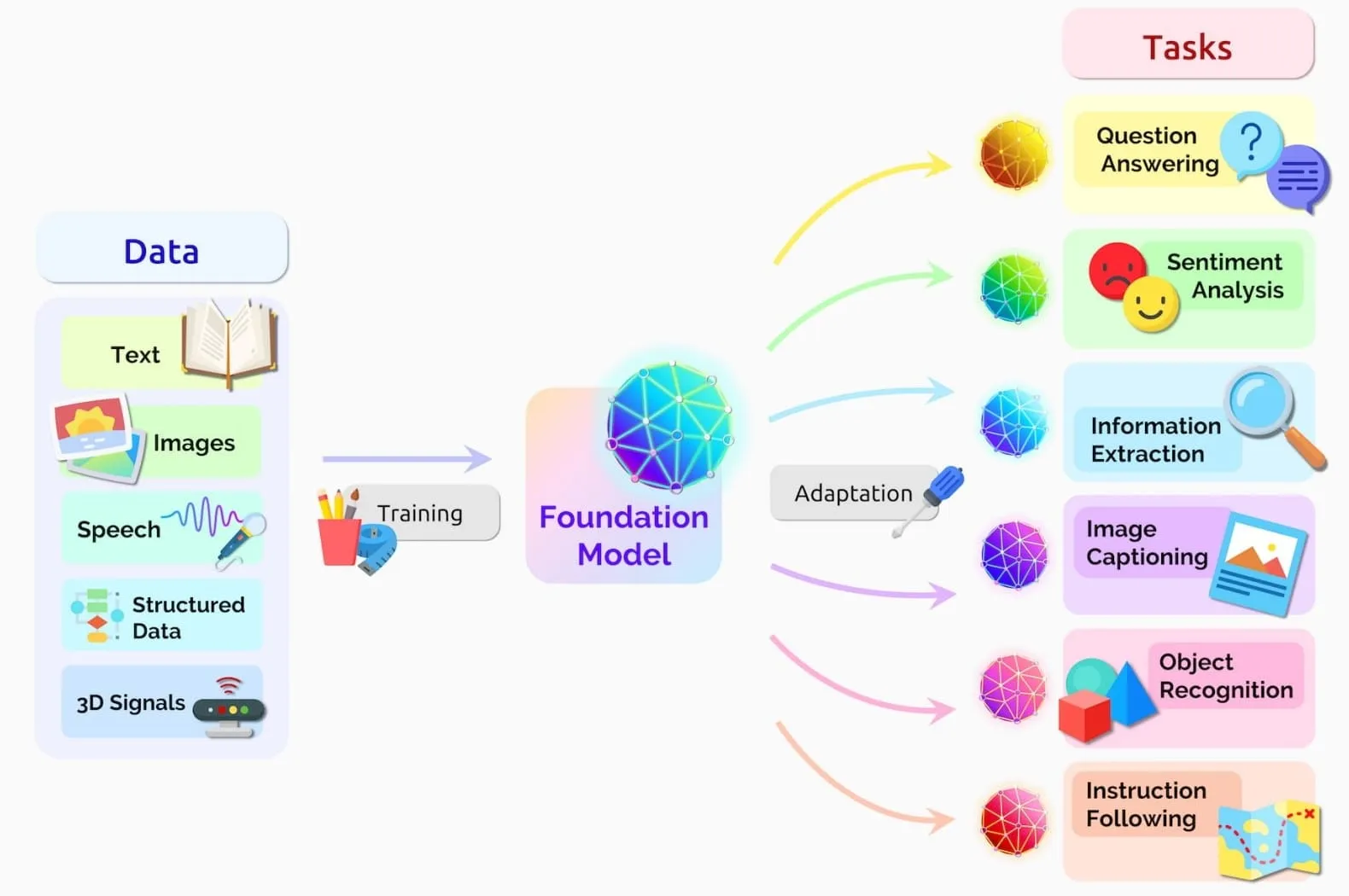

Capa modelo de IA generativa

La capa modelo de la IA generativa inicia lo que se conoce como un modelo básico. Este modelo de aprendizaje automático a gran escala se entrena combinado con datos sin etiquetar mediante el uso de un algoritmo Transformer. El proceso de capacitación y ajuste permite que el modelo básico evolucione hasta convertirse en una herramienta versátil que se puede adaptar a una amplia variedad de tareas, para respaldar las capacidades de diversas aplicaciones de IA generativa.

Fuente: NVIDIA.

Actualmente, el mercado ofrece cientos de modelos básicos capaces de comprender diversos aspectos como el lenguaje, la visión, la robótica, el razonamiento y la búsqueda. Para el año 2027, Gartner predice que los modelos básicos sustentarán el 60% de los casos de uso de PNL (procesamiento del lenguaje natural). Esto marca un aumento significativo desde menos del 10% en 2022. Se espera que este crecimiento provenga principalmente de modelos de dominios específicos, que se perfeccionarán utilizando modelos básicos de propósito general como base.

Los modelos básicos se pueden clasificar en términos generales en dos categorías principales: modelos de código cerrado (o propietarios) y modelos de código abierto.

- Modelos de código cerrado: Estos modelos pertenecen y están controlados por organizaciones específicas como OpenAI, y el código fuente subyacente, los algoritmos, los datos de entrenamiento y los parámetros se mantienen privados.

- Modelos de código abierto: Por el contrario, estos modelos son accesibles para todos sin restricciones. Fomentan la colaboración y el desarrollo de la comunidad, lo que permite un examen y modificación transparente del código.

Modelos de base de código cerrado

Los modelos básicos de código cerrado (o propietarios) están disponibles para el público a través de una interfaz de programación de aplicaciones (API). Los terceros pueden utilizar esta API para sus aplicaciones, consultando y presentando información del modelo básico sin la necesidad de gastar recursos adicionales en capacitación, ajuste o ejecución del modelo.

Estos modelos a menudo tienen acceso a datos de capacitación patentados y tienen acceso prioritario a los recursos de computación en la nube. Las grandes empresas de computación en la nube suelen crear modelos básicos de código cerrado, ya que entrenar estos modelos requiere una inversión significativa. Los modelos de código cerrado generan ingresos cobrando a los clientes por el uso de API o el acceso basado en suscripción.

Los modelos de lenguajes grandes (LLM, por sus siglas en inglés) como GPT-4 de OpenAI y PaLM 2 de Google son modelos básicos específicos de código cerrado que se centran en el procesamiento del lenguaje natural. Se han configurado para aplicaciones como chatbots, como ChatGPT y Bard. Un ejemplo sin lenguaje es DALL-E 2 de OpenAI, un modelo de visión que reconoce y genera imágenes.

Modelos básicos de código abierto

Los modelos básicos de código abierto se desarrollan de forma colaborativa. Están disponibles gratuitamente para su redistribución y modificación, lo que proporciona total transparencia en los datos de entrenamiento y el proceso de creación de modelos. Muchos incluso se distribuyen sin costo alguno, dependiendo de la licencia y los datos.

Los beneficios de utilizar modelos de código abierto incluyen:

- Control total y privacidad de los datos; a diferencia de compartir con modelos de código cerrado como GPT de OpenAI

- Personalización mejorada con indicaciones específicas, ajustes y filtrado para optimizar para diversas industrias

- Entrenamiento e inferencia rentables de modelos de dominio específico (los modelos más pequeños requieren menos computación)

Ejemplos de modelos de código abierto son [Llama 2] de Meta (https://ai.meta.com/llama/), [Dolly 2.0] de Databricks (https://www.databricks.com/blog/2023/04/12/dolly-first-open-commercially-viable-instruction-tuned-llm), Stability AI [Stable Diffusion] XL](https://stability.ai/stablediffusion) y Cerebras-GPT. Para obtener una lista completa y actualizada, consulte la [Tabla de clasificación de LLM abiertos] de Hugging Face (https://huggingface.co/spaces/HuggingFaceH4/open_llm_leaderboard), que rastrea, clasifica y evalúa los LLM abiertos y los chatbots.

Capa de infraestructura de IA generativa

La capa de infraestructura de la IA generativa abarca los componentes vitales que subyacen a los modelos de cimentación a gran escala. Los recursos clave involucrados en este proceso son semiconductores, redes, almacenamiento, bases de datos y servicios en la nube, todos los cuales desempeñan papeles cruciales tanto en la capacitación inicial como en el ajuste, la personalización y la inferencia continua de los modelos de IA generativa. Los modelos de IA generativa funcionan a través de dos fases principales:

Fuente: NVIDIA.

- Fase de capacitación: Aquí es donde ocurre el aprendizaje, generalmente dentro de un centro de datos en la nube en un clúster de computación acelerado. En esta fase de computación intensiva, un modelo de lenguaje grande (LLM) aprende de un conjunto de datos determinado. Los parámetros son las variables internas que el modelo ajusta para representar los patrones subyacentes en los datos de entrenamiento. Los tokens se refieren a los fragmentos de texto individuales que procesa el modelo, como palabras o subpalabras. Por ejemplo, GPT-3 se entrenó con 300 mil millones de tokens, con un token equivalente a 1,33 palabras, provenientes principalmente de Common Crawl de Internet, Wikipedia, libros y artículos.

- Fase de inferencia: Este es el proceso de utilizar un modelo de IA entrenado para generar respuestas de los usuarios. Aquí, las nuevas entradas de texto se tokenizan en unidades individuales y el modelo utiliza los parámetros aprendidos durante el entrenamiento para interpretar estos tokens y generar los resultados correspondientes. Estos modelos de IA entrenados requieren una potencia informática significativa y deben implementarse cerca de los usuarios finales (en un centro de datos perimetral) para minimizar los retrasos en la respuesta (latencia), ya que la interacción en tiempo real es esencial para mantener a los usuarios interesados.

En general, la precisión de la IA generativa depende del tamaño del LLM y del volumen de datos de entrenamiento utilizados. Estos factores, a su vez, requieren una infraestructura sólida compuesta de semiconductores, redes, almacenamiento, bases de datos y servicios en la nube.

Semiconductores

Los semiconductores habilitan el hardware subyacente para la computación, facilitando el procesamiento y los cálculos complejos necesarios para los modelos de IA generativa. Son materiales esenciales utilizados en la fabricación de varios tipos de unidades de procesamiento de computación acelerada, a saber, unidades de procesamiento de gráficos (GPU), circuitos integrados de aplicaciones específicas (ASIC), incluidas unidades de procesamiento de tensores (TPU), y matrices de puertas programables en campo (FPGA).

Ejemplos clave de estos aceleradores de hardware (utilizados por Microsoft, Amazon, Meta y Google) son los siguientes:

- GPU: GPU Hopper (H100) de NVIDIA, que Microsoft utiliza mucho

- ASIC: Los ASIC AWS Trainium (Trn1) y AWS Inferentia (Inf1) de Amazon, que están diseñados para entrenamiento e inferencia, respectivamente. Además, el Meta Training and Inference Accelerator (MTIA) es otro ASIC personalizado.

- TPU: TPU v4 de Google Cloud

- FPGA: La instancia AWS F1 de Amazon funciona con FPGA

Estos aceleradores de hardware son particularmente adecuados para tareas que se pueden dividir en tareas paralelas más pequeñas, como las que se encuentran en la IA generativa.

LEER MÁS: Computación acelerada: ¿Qué es? y ¿Cómo funciona?

Redes

La creación de redes desempeña un papel crucial en la IA generativa, ya que facilita el intercambio eficiente de datos entre sistemas de IA. Esto es particularmente importante cuando se trata de necesidades de gran ancho de banda en la comunicación de servidor a servidor, también conocida como tráfico este-oeste, dentro de clústeres informáticos acelerados.

Las destacadas tecnologías de red para cargas de trabajo de IA, como InfiniBand y Ethernet, se complementan con interconexiones de gran ancho de banda como NVLink (desarrollada por NVIDIA). Juntas, estas tecnologías brindan soluciones que permiten conexiones entre componentes internos y externos de clústeres de IA. Su coordinación garantiza una transferencia de datos eficiente entre centros de datos en la nube, con alto rendimiento y latencia mínima.

LEER MÁS: Redes en la nube: redes de centros de datos de próxima generación

Almacenamiento

El almacenamiento desempeña un papel vital en las fases de entrenamiento e inferencia de los modelos generativos de IA, permitiendo la retención de grandes cantidades de datos de entrenamiento, parámetros de modelos y cálculos intermedios. Los sistemas de almacenamiento paralelo mejoran la tasa general de transferencia de datos al proporcionar acceso simultáneo a múltiples rutas de datos o dispositivos de almacenamiento. Esta funcionalidad permite leer o escribir grandes cantidades de datos a un ritmo mucho más rápido que el que se puede lograr con una sola ruta.

En el contexto del entrenamiento de IA generativa, existe la necesidad de leer conjuntos de datos de origen a velocidades extremadamente altas y escribir puntos de control de parámetros lo más rápido posible. Durante la inferencia, donde los modelos entrenados responden a las solicitudes de los usuarios, es esencial un alto grado de rendimiento de lectura. Esta capacidad permite el uso rápido de un LLM, utilizando millas de millones de parámetros almacenados, para generar la respuesta más adecuada.

bases de datos

Las bases de datos, particularmente los tipos no relacionales (NoSQL), son vitales para la IA generativa. Facilitan el almacenamiento y la recuperación eficientes de grandes conjuntos de datos no estructurados necesarios para entrenar modelos complejos como Transformers. El uso de Azure Cosmos DB (la base de datos NoSQL de Microsoft dentro de Azure) por parte de OpenAI para escalar dinámicamente el servicio ChatGPT subraya la necesidad de bases de datos que sean a la vez altamente eficientes y escalables en el ámbito de la IA generativa.

Servicios en la nube

Los proveedores de servicios en la nube (CSP) como Amazon Web Services (AWS), Microsoft Azure y Google Cloud ofrecen recursos informáticos (impulsados por semiconductores), redes, almacenamiento, bases de datos y varios otros servicios que permiten el entrenamiento y el despliegue de modelos complejos de IA generativa. Dentro de sus centros de datos, divididos en regiones de nube y zonas de disponibilidad, albergan el hardware físico esencial, como servidores y equipos de TI, lo que hace que estas operaciones sean escalables y fácilmente accesibles.

Estos CSP se especializan en ofrecer ofertas de infraestructura como servicio (IaaS), hechas a medida para la capacitación y el despliegue de modelos de IA generativa. Ejemplos de sus ofertas específicas son los siguientes:

- AWS: Amazon ofrece instancias EC2 P5, que funcionan con la GPU NVIDIA H100 Tensor Core y ofrecen hasta 20 exaFLOPS de rendimiento informático.

- Microsoft Azure: Ofrecen instancias NVIDIA A10G v5, que funcionan con la GPU NVIDIA A10G Tensor Core, y proporcionan hasta 250 teraFLOPS de rendimiento informático.

- Google Cloud: A través de las máquinas virtuales G2, ofrece la GPU L4 Tensor Core de NVIDIA, capaz de alcanzar hasta 242 teraFLOPS de rendimiento informático.