La gravedad de los datos se está trasladando a la nube, a medida que proveedores como Amazon Web Services (AWS) y Microsoft Azure incorporan volúmenes cada vez mayores de datos a sus plataformas. Mientras tanto, como se muestra en el índice de gravedad de datos de Digital Realty, los proveedores de centros de datos de colocación están facilitando esta migración de datos al actuar como una rampa de acceso a la nube.

La gravedad de los datos es el concepto de que los datos tienen masa, y cuanto más crece esa masa, mayor es su atracción gravitacional, pero más difícil es moverlos. Por lo tanto, se deben utilizar grandes volúmenes de datos, pero no moverlos. En cambio, las aplicaciones y servicios se acercarán a los datos a través de fuerzas de atracción.

Centro Infra proporciona una descripción detallada de la gravedad de los datos, incluido su significado, los problemas que presenta y su transición a través de entornos de nube híbrida. Además, revisamos cómo la gravedad de los datos es una oportunidad para los proveedores de servicios en la nube (CSP) como Amazon Web Services (AWS) y Microsoft Azure. Finalmente, Centro Infra hace referencia al índice de gravedad de datos de Digital Realty, que mide la creciente intensidad y fuerza gravitacional de la creación de datos empresariales.

¿Qué es la gravedad de datos?

La gravedad de los datos es el concepto de que, al igual que un planeta, los datos tienen masa y cuanto mayor se vuelve esa masa, mayor es su atracción gravitacional y es más probable que aplicaciones y servicios se sientan atraídos hacia ellos.

Históricamente, los datos se creaban o se enviaban a ubicaciones centralizadas para su procesamiento. Sin embargo, hoy en día, los datos se crean y procesan en todas partes: en edificios de oficinas, hogares, automóviles, así como en todos los teléfonos inteligentes y dispositivos inteligentes.

A medida que las empresas crean cada vez más datos, los agregan, almacenan e intercambian, atrayendo progresivamente más aplicaciones y servicios para comenzar a analizar y procesar sus datos. Esta “atracción” se debe a que estas aplicaciones y servicios requieren un mayor ancho de banda y/o un acceso de menor latencia a los datos.

Por lo tanto, a medida que los datos se acumulan en tamaño, en lugar de empujar los datos a través de las redes hacia aplicaciones y servicios, la “gravedad” comienza a atraer aplicaciones y servicios hacia los datos. Este proceso se repite, lo que produce un efecto compuesto, lo que significa que a medida que crece la escala de datos, se vuelven “más pesados” y cada vez más difíciles de replicar y reubicar.

En última instancia, el “peso” de estos datos que se crean y almacenan genera una “fuerza” que resulta en la incapacidad de mover los datos, de ahí el término gravedad de los datos.

Problema de gravedad de datos

La gravedad de los datos presenta un problema fundamental para las empresas, que es la incapacidad de mover datos a escala. En consecuencia, la gravedad de los datos impide el rendimiento del flujo de trabajo empresarial, aumenta las preocupaciones regulatorias y de seguridad y aumenta los costos.

Estos desafíos surgen porque es demasiado lento y costoso transportar datos desde varias ubicaciones globales a un centro de datos local o en la nube. Dicho de otra manera, si bien puede ser barato crear datos, es costoso moverlos de un lado a otro, debido a los costos de tránsito y las tarifas de salida de datos.

Por ejemplo, es posible que un desarrollador o una empresa desee comenzar a mover datos en su organización. En gigabytes y terabytes de datos, el proceso de transferencia es asequible e indoloro, y toma solo de minutos a horas.

Unidades de datos

| Kilobyte | 1.000 bytes |

| Megabyte | 1.000.000 bytes |

| Gigabites | 1.000.000.000 bytes |

| Terabyte | 1.000.000.000.000 bytes |

| Petabyte | 1.000.000.000.000.000 bytes |

| Exabyte | 1.000.000.000.000.000.000 bytes |

Sin embargo, una vez que estos desarrolladores y empresas alcanzan la escala de petabytes de datos, que varias organizaciones han almacenado en la nube, el movimiento de datos se vuelve prohibitivo en términos de tiempo y costos.

En general, el “problema” de la gravedad de los datos significa que la proximidad de los datos es crítica. Como resultado, las empresas necesitan diseñar su infraestructura digital en función de factores que incluyen dónde están ubicadas las unidades de negocios y dónde se encuentran los usuarios finales de los datos. Además, las regulaciones locales de almacenamiento de datos agregan consideraciones adicionales sobre la privacidad y el cumplimiento de los datos, lo que se conoce colectivamente como localización de datos.

Nube híbrida

La gravedad de los datos es un problema particularmente grave porque las empresas crean y almacenan su creciente masa de datos en entornos de nube híbridos. La nube híbrida es donde las empresas implementan aplicaciones, que utilizan computación y almacenamiento, en una combinación de diferentes entornos, incluidos los locales, la nube privada y la nube pública.

LEER MÁS: Nube híbrida: ¿Qué es? y ¿Cómo funciona?

Ejemplos de gravedad de datos

A continuación se muestran ejemplos de Delta Air Lines y el dominio de la inteligencia artificial (IA) de los impactos de la gravedad de los datos en entornos de nube híbrida:

- Delta Air Lines: migrar el 90 % de sus aplicaciones y bases de datos a entornos de nube para 2024 con el fin de mejorar la experiencia del cliente (por ejemplo, el proceso de reserva) y la eficiencia en todas sus operaciones de vuelo. Sin embargo, por razones de gravedad de los datos, seguridad, complejidad y costo de sus aplicaciones heredadas, Delta optó por implementar una arquitectura de nube híbrida, construida sobre la plataforma Red Hat OpenShift de IBM. Como resultado, Delta trasladará la gran mayoría de sus datos a la nube pública, pero aún mantendrá ciertos datos confidenciales en las instalaciones, como la información de tarjetas de crédito, creando gravedad de datos en ambos entornos

- Inteligencia artificial (IA): las empresas que utilizan datos con fines de inteligencia artificial tienen diferentes requisitos sobre dónde deben residir sus datos. Algunas empresas no tienen ni pueden tener estos datos residiendo en la nube pública. Al mismo tiempo, la gravedad de los datos hace que estos datos sean muy difíciles de mover. Por lo tanto, a menudo es necesario “llevar” la capacidad de cálculo de la inteligencia artificial hacia donde residen los datos de la empresa – llevando aplicaciones y servicios a los datos

LEER MÁS: El uso de ChatGPT y OpenAI de la infraestructura en la nube de Azure

Como se destaca en los ejemplos anteriores, la gravedad de los datos se está creando en dos entornos separados (nube pública y local) y las aplicaciones y servicios se atraen a cada ubicación. Además, las empresas utilizarán centros de datos de colocación para proporcionar servicios de conectividad, que les permitan conectar su infraestructura de TI con el fin de intercambiar tráfico y acceder a servicios en la nube.

LEER MÁS: Colocación – Definición, Significado, Centro de Datos, Servicios

A través de una conexión física, conocida como conexión cruzada, las empresas y los proveedores de servicios en la nube pueden intercambiar datos de forma segura en múltiples áreas metropolitanas globales para influir de manera eficiente en la gravedad de sus datos.

Gravedad de datos en la nube

Las empresas están migrando su infraestructura de TI a la nube, dados sus beneficios en escalabilidad, pago por uso y velocidad y agilidad, pero también por el impacto de la gravedad de los datos. A medida que las empresas almacenan más datos en la nube, comienzan a atraer más aplicaciones y servicios, que necesitan proximidad a esos datos en la nube.

La gravedad de los datos se traslada a la nube

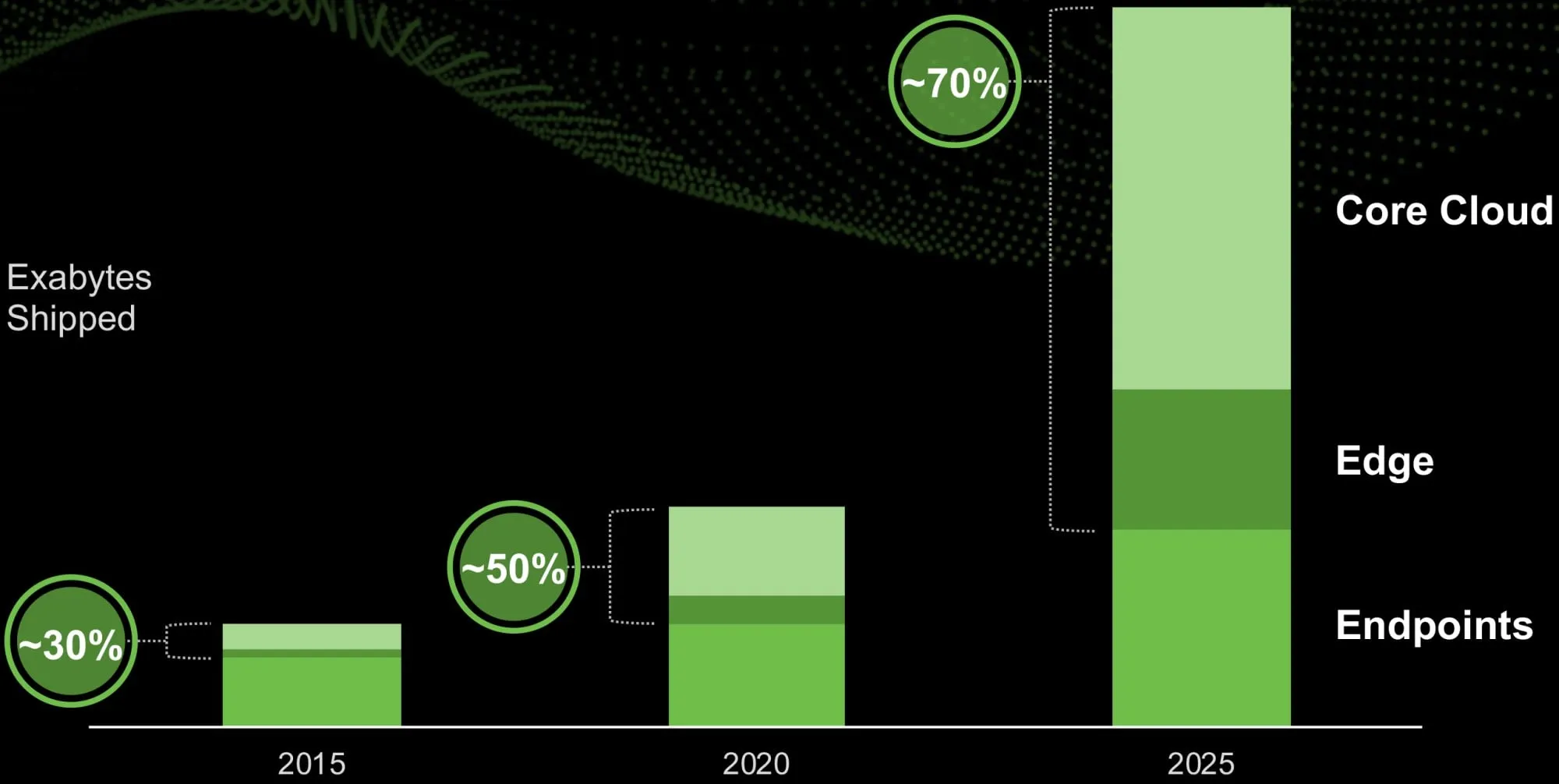

Para 2025, Seagate Technology, una empresa de almacenamiento de datos, proyecta que aproximadamente el 70 % de los datos de una empresa se almacenarán en una combinación de la nube y el borde.

Haga clic aquí para ver una versión más grande de esta imagen.

Como se muestra en el gráfico anterior, la nube representa el componente más grande de este cambio en la gravedad de los datos, impulsado por grandes empresas (por ejemplo, bancos, compañías de seguros, fabricantes) y entidades gubernamentales, que migran de entornos locales a entornos de nube.

LEER MÁS: Migración local a la nube: un viaje a AWS y Azure

Una vez que las empresas trasladan datos desde ubicaciones locales a entornos de nube, se encuentran disponibles una serie de nuevos servicios de nube. Dos ejemplos principales de estos servicios en la nube, que se relacionan con la gravedad de los datos, son los almacenes de datos y los lagos de datos, que se definen de la siguiente manera:

- Data Warehouse: depósito central de información diseñado específicamente para el análisis de datos. Los almacenes de datos contienen datos relacionales de sistemas transaccionales, bases de datos operativas y aplicaciones de línea de negocios.

- Data Lake: repositorio central que permite almacenar todos los datos, incluida la información estructurada, semiestructurada y no estructurada.

LEER MÁS: Data Lake: una única fuente de verdad en la nube

Al utilizar almacenes y lagos de datos, las empresas comienzan a trabajar activamente dentro del entorno de nube elegido. A su vez, esto conduce a compartir, colaborar y establecer relaciones con los datos, tanto dentro de una empresa como (igualmente importante) entre diferentes organizaciones. Por lo tanto, se produce una dependencia de los datos tanto dentro como entre empresas, lo que conduce a la rigidez, la retención y la gravedad de los datos en la nube.

Gravedad de datos en AWS

Amazon Web Services (AWS), el mayor proveedor de servicios en la nube a nivel mundial, muestra la importancia de la gravedad de los datos a través de su servicio de almacenamiento S3, que actualmente contiene más de 200 billones de objetos, lo que equivale a casi 29.000 objetos por cada residente en el planeta Tierra.

AWS ha formado un círculo virtuoso en el que se crean aplicaciones y servicios para analizar y procesar datos en la plataforma, lo que a su vez crea más datos que son analizados por otras aplicaciones y servicios.

Como se vio anteriormente, AWS ofrece los dos principales servicios en la nube relacionados con la gravedad de los datos: Amazon Redshift, su servicio de almacenamiento de datos y una oferta de lago de datos. Ambos servicios permiten a las empresas almacenar cantidades masivas de datos dentro de AWS.

Amazon Redshift: almacén de datos

Amazon Redshift es el servicio de almacén de datos de AWS, que utiliza SQL para analizar datos estructurados y semiestructurados en almacenes de datos, bases de datos operativas y lagos de datos. El servicio permite a los clientes analizar datos desde terabytes hasta petabytes y ejecutar consultas analíticas complejas.

Lago de datos

El servicio de lago de datos de AWS es un repositorio central que permite a los clientes almacenar todos sus datos estructurados y no estructurados a cualquier escala. Esto incluye datos de dispositivos de Internet de las cosas (IoT), sitios web, aplicaciones móviles, redes sociales y aplicaciones corporativas.

LEER MÁS: Amazon Web Services (AWS) IoT – Conexión de dispositivos

En una arquitectura de lago de datos, las empresas pueden mover petabytes a exabytes de datos a AWS. Dada esta inmensa escala, los datos se convierten en el centro de gravedad y todos los usuarios, aplicaciones y servicios son atraídos para obtener acceso a los datos.

Pero ¿cómo mueven las empresas petabytes y exabytes de datos desde sus ubicaciones locales y/o centros de datos de colocación a AWS?

Aparatos físicos

AWS ha creado tres dispositivos físicos para incorporar de manera más rápida y rentable enormes cantidades de datos a AWS, a través de transferencias de datos fuera de línea, en lugar de transferencias de datos en red. Estos dispositivos físicos se conocen como AWS Snowball (42 terabytes utilizables), AWS Snowball Edge (80 terabytes utilizables) y AWS Snowmobile (hasta 100 petabytes). Para aclarar, AWS moverá datos físicamente, no a través de una red, sino que los enviará, recogerá y trasladará a un centro de datos de AWS.

LEER MÁS: Ubicaciones de los centros de datos de Amazon Web Services (AWS)

Estos dispositivos físicos son el ejemplo más tangible de cómo AWS intenta trasladar la gravedad de los datos a la nube y, a su vez, acelerar la adopción de la nube por parte de empresas establecidas.

AWS Snowmobile – Gravedad de datos – Estudio de caso

AWS Snowmobile es un servicio de transferencia de datos mediante el cual se pueden transferir hasta 100 petabytes de datos a AWS en cada Snowmobile, que es un contenedor de envío de 45 pies de largo, transportado por un camión semirremolque. Vea la descripción general de AWS Snowmobile en el siguiente vídeo:

DigitalGlobe, un proveedor de imágenes de la Tierra de alta resolución, fue el primer cliente en utilizar la solución de transferencia de datos AWS Snowmobile para resolver su problema de gravedad de datos.

Durante los últimos 20 años, DigitalGlobe ha acumulado más de 100 petabytes de datos, y este volumen crece a un ritmo de 10 petabytes cada año. La empresa utilizó la solución AWS Snowmobile para mover petabytes de sus datos de archivo, desde su propia infraestructura de TI local, a la nube, en Amazon Web Services (AWS).

Tradicionalmente, el proceso de transferencia de datos de varios petabytes de DigitalGlobe habría llevado meses, a través de una línea de 10 gigabits por segundo (Gbps), y habría tenido un costo prohibitivo. Sin embargo, con AWS Snowmobile, DigitalGlobe pudo entregar petabytes de datos en semanas y, al mismo tiempo, ahorrar costos.

Como punto de referencia, un trabajo de AWS Snowmobile cuesta $0,005/GB por mes, según la cantidad de capacidad de almacenamiento aprovisionada de Snowmobile.

Gravedad de datos en Azure

Microsoft Azure, el segundo mayor proveedor de servicios en la nube a nivel mundial, considera la gravedad de los datos como un indicador clave de rendimiento (KPI). La compañía destaca el Data Estate como múltiples ubicaciones donde se almacenan los datos de una empresa, tanto virtual como geográficamente, incluidas bases de datos operativas, almacenes de datos y lagos de datos. Llevar el patrimonio de datos de una empresa a Microsoft Azure crea un efecto de volante en la nube, lo que resulta en una atracción gravitacional para más datos, aplicaciones y servicios.

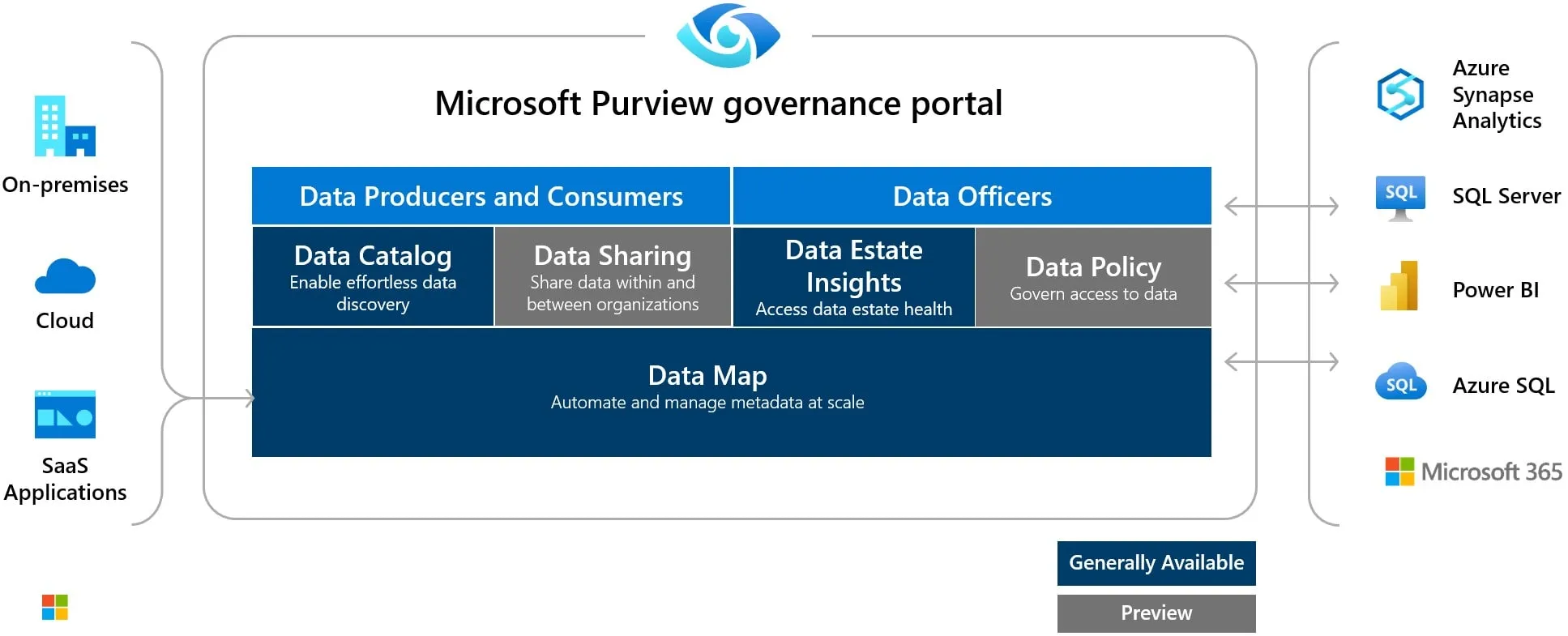

Más allá de los almacenes de datos y los lagos de datos, Microsoft Azure destaca su servicio Microsoft Purview como impulsor de la gravedad de los datos. Con este fin, en una reciente conferencia telefónica sobre resultados, el director ejecutivo de Microsoft Corporation, Satya Nadella, afirmó que los “requisitos regulatorios” y la “gobernanza de los datos” son ejemplos de razones por las cuales “Azure Purview se convierte, nuevamente, en un impulsor bastante importante de esa gravedad de los datos hacia la nube desde una perspectiva de gobernanza”.

Competencia de Microsoft

Microsoft Purview es una combinación de la cartera anterior de Azure Purview y Microsoft 365 Compliance. El servicio de gobierno de datos ayuda a las empresas a gestionar sus datos locales, de múltiples nubes y de software como servicio (SaaS).

Haga clic aquí para ver una versión más grande de esta imagen.

Por ejemplo, Microsoft Purview crea un mapa holístico de los datos de una empresa, con descubrimiento automatizado de datos y clasificación de datos confidenciales. Sobre este mapa se construyen aplicaciones y servicios que crean entornos para el descubrimiento de datos, la gestión del acceso y la información sobre los datos de una empresa. La gravedad de los datos se hace evidente a medida que más de estas aplicaciones y servicios son “atraídos” hacia Microsoft Purview.

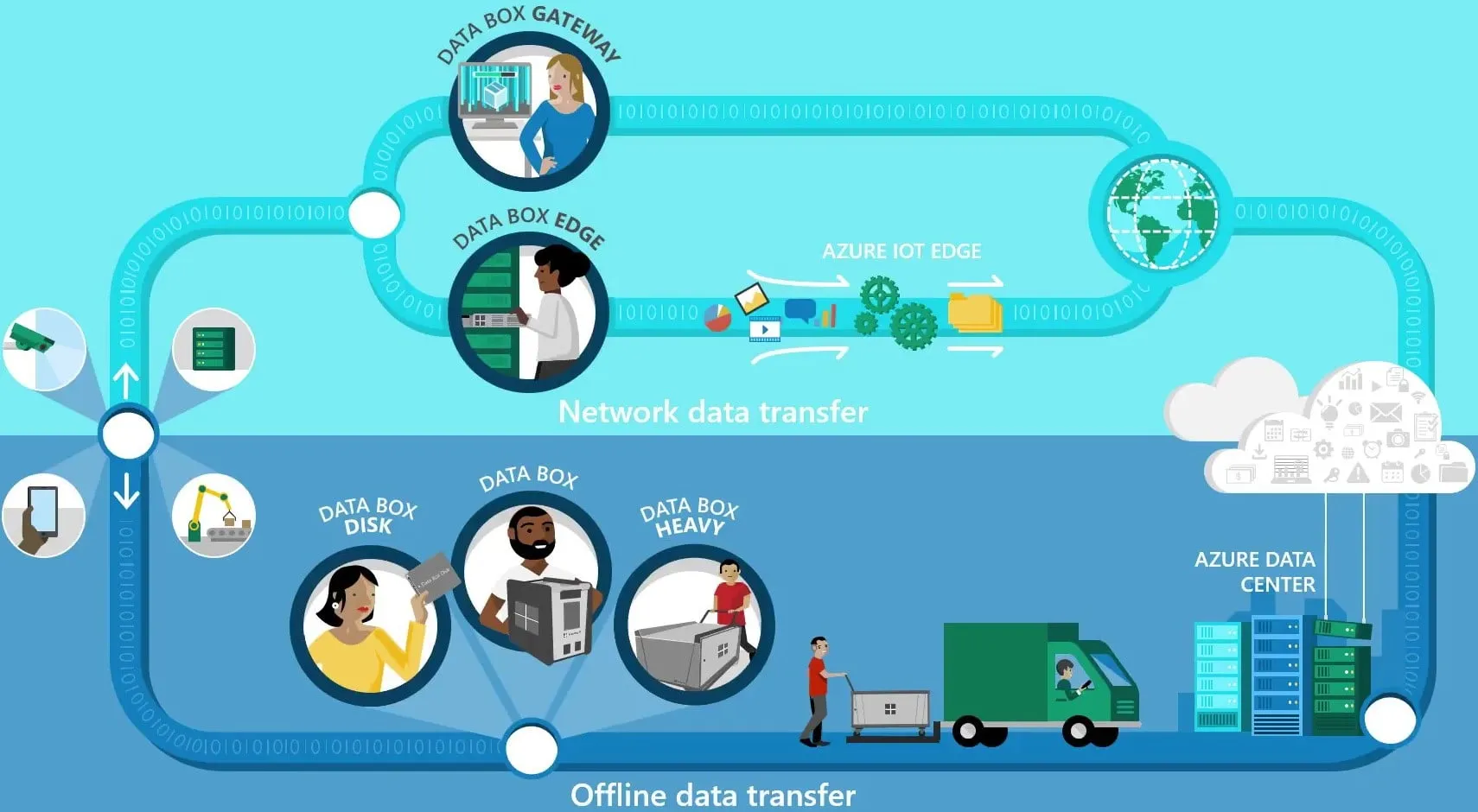

Aparatos físicos

Microsoft Azure ha creado tres dispositivos físicos para incorporar de forma rápida y rentable cantidades masivas de datos a Azure, a través de transferencias de datos fuera de línea, en lugar de transferencias de datos en red.

Haga clic aquí para ver una versión más grande de esta imagen.

Como se muestra arriba, estos dispositivos físicos se conocen como Data Box Disk (35 terabytes utilizables), Data Box (80 terabytes utilizables) y Data Box Heavy (800 terabytes utilizables).

Microsoft Azure prepara y envía estos dispositivos directamente a los clientes. Una vez que el cliente copia sus datos en el dispositivo Data Box, puede enviar el dispositivo de regreso a un centro de datos de Azure, dentro de la región de Azure que desee.

LEER MÁS: Ubicaciones y regiones del centro de datos de Microsoft Azure

Índice de gravedad de datos

El Data Gravity Index es un pronóstico global creado por Digital Realty, un operador de centros de datos, que mide la creciente intensidad y fuerza gravitacional de la creación de datos empresariales. Digital Realty utiliza el índice para ayudar a las empresas a encontrar ubicaciones óptimas (es decir, centros de datos) para almacenar sus datos, una noción que se vuelve cada vez más importante a medida que esta masa y actividad de datos continúan aumentando.

Puntuación del índice de gravedad de datos

La puntuación del índice de gravedad de datos mide la intensidad y la fuerza gravitacional del crecimiento de los datos empresariales para las empresas Global 2000 en 53 áreas metropolitanas y 23 industrias a nivel mundial. Esta puntuación, medida en gigabytes por segundo, proporciona un indicador relativo para determinar la creación, agregación y procesamiento de datos.

A nivel mundial, se espera que la intensidad de gravedad de datos, medida en gigabytes por segundo, crezca a una tasa de crecimiento anual compuesta (CAGR) del 139 % hasta 2024. A nivel regional, la herramienta Data Gravity Intensity pronostica las siguientes tasas de crecimiento hasta 2024:

Intensidad de gravedad de datos

| Región | Tasa de crecimiento anual compuesta (CAGR) |

| América del Norte | 137% |

| Europa, Oriente Medio y África | 133% |

| Asia-Pacífico | 153% |

| A nivel mundial | 139% |

Además, Digital Realty identifica que ciertas áreas metropolitanas tienen flujos de datos significativos o “fuerza gravitacional” entre sí, que es uno de los impulsores clave del ancho de banda de interconexión. Dada la atracción gravitacional entre áreas metropolitanas que albergan volúmenes significativos de datos (por ejemplo, Londres y Ámsterdam), esto crea una mayor intensidad de gravedad de datos.

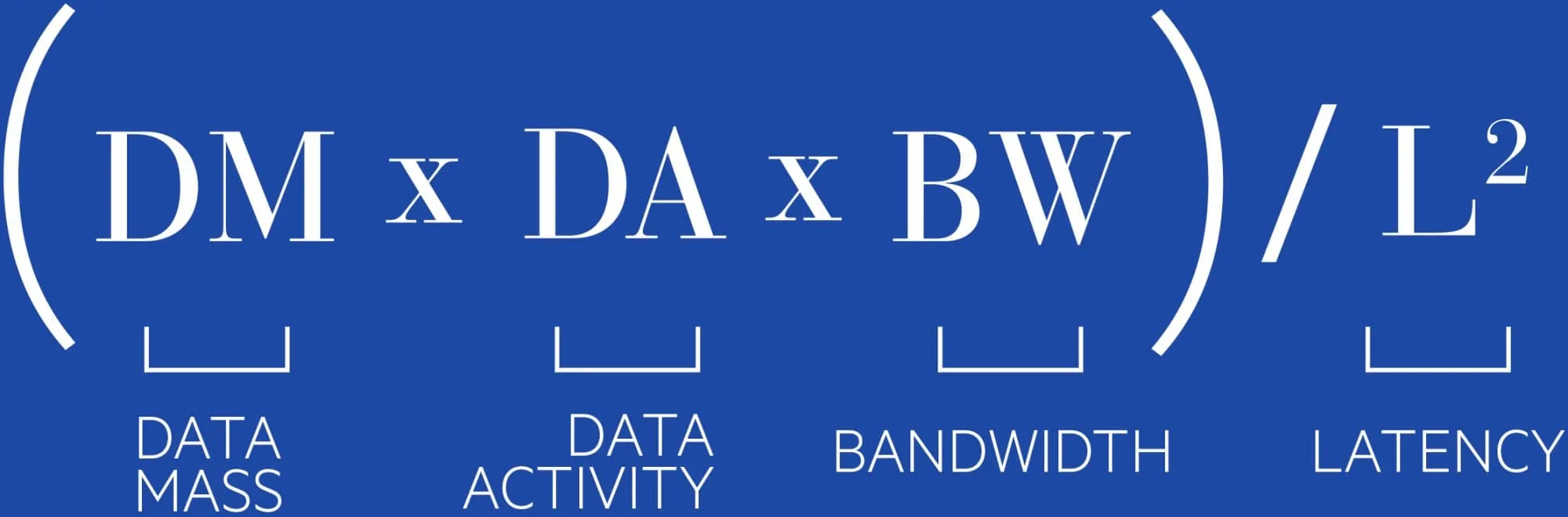

Fórmula del índice de gravedad de datos

Digital Realty desarrolló la siguiente fórmula del índice de gravedad de datos para medir, cuantificar y determinar la creación, agregación e intercambio privado de datos empresariales a nivel mundial:

Los componentes de esta fórmula del índice de gravedad de datos se pueden definir de la siguiente manera:

- Masa de datos: volumen de datos que se acumulan, es decir, se almacenan o retienen, en un metro durante un período de tiempo.

- Actividad de datos: cantidad de datos que están en movimiento, a través de creación e interacciones, en un metro durante un período de tiempo.

- Ancho de banda: cantidad promedio de ancho de banda disponible en un metro o entre dos metros

- Latencia: latencia promedio entre todos los metros y un solo metro, o entre dos metros específicos

En última instancia, el ancho de banda es un multiplicador de la gravedad de los datos, y un mayor ancho de banda significa que un metro tiene más potencial. Si bien la latencia es un inhibidor de la gravedad de los datos, una latencia más alta significa que un metro tiene menos potencial.

En general, para utilizar datos empresariales con mayor rendimiento y menor latencia, las aplicaciones y los servicios deben estar muy cerca de los datos.